Fernsehtechnik - Übertragungsverfahren für Bild, Ton und Daten

Die Fernsehtechnik umfasst verschiedene Übertragungsverfahren für Bild, Ton und Daten. Dieser Artikel bietet einen Überblick über die Entwicklung und Anwendung dieser Verfahren. Beginnend mit der Übertragung von Bild- und Toninformationen werden die Hinzunahme von Farbinformationen sowie die Übertragung von analogen und digitalen Farbbildsignalen untersucht. Darüber hinaus werden Themen wie das hochauflösende Fernsehverfahren HDTV, Datenreduktion, trägerfrequente Übertragung von digitalen Fernsehsignalen und die Übertragung von zusätzlichen Prüf- und Datensignalen behandelt. Der Artikel schließt mit einem Literaturverzeichnis für weiterführende Informationen zu diesem Thema.

Inhaltsverzeichnis

Vorwort

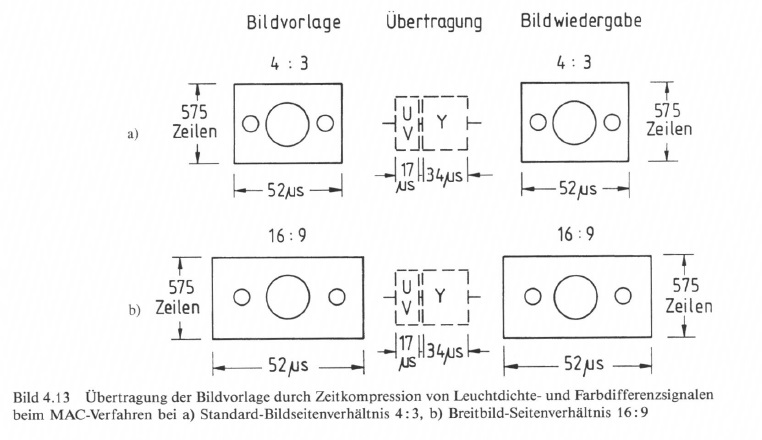

Die Fernsehtechnik befindet sich seit mehr als einem Jahrzehnt in einer Phase des Umbruchs, in der verschiedene Ansätze zu verzeichnen sind, das eingeführt PAL-System entweder kompatibel zu verbessern oder alternativ dazu neue, verbesserte Übertragungsverfahren für Bild und Ton einzuführen. So wurden auf der Basis des Frequenzmultiplex-Systems verbesserte PAL-Verfahren wie I-PAL, Q-PAL u. a. bekannt sowie das auf dem Zeitmultiplex-Prinzip basierende MAC-Verfahren, das nach Beschluß der EG-Kommission ein für Europa einheitlicher Standard für Satelliten-Fernsehübertragung werden sollte. Aus der parallelen Entwicklung an einem Hochzeilen-Fernsehen (HDTV) übernahm man dann für das MAC-Verfahren das 16:9-Bildseitenverhältnis als besonderes Attribut. In einem weiteren Schritt folgte eine „Quasi"-HDTV-Übertragung nach dem zu D2-MAC kompatiblen HD-MAC-Verfahren. Beim Fernsehzuschauer kamen diese Neuerungen allerdings aus verschiedenen Gründen nicht an.

Grundig Monolith Fernseher - noch mit einer alten Kathodenstrahl-Bildröhre im 4:3 Bildformat

Im Lager der PAL-Enthusiasten begriff man dies erneut als Chance zur Einführung eines verbesserten PAL-Verfahrens im Zusammenhang mit dem Übergang auf das Breitbild-Format. Das PALplus-System wurde von einem Gremium, dem verschiedene europäische Rundfunkanstalten, das Institut für Rundfunktechnik und namhafte Endgerätehersteller angehören, zu einem neuen Standard erhoben.

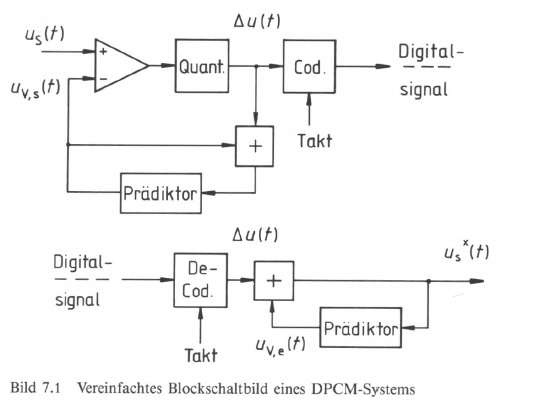

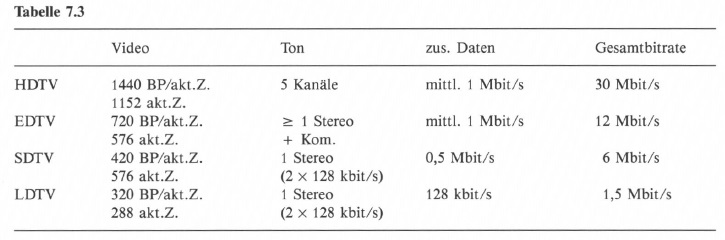

Die weitere Entwicklung eines HDTV-Verfahrens erfuhr eine entscheidende Wende durch den Beschluß, in den USA nur ein digitales HDTV-Verfahren einzuführen. Damit wurden auch die Weichen für einen digitalen TV-Standard in Europa gestellt, der nun hierarchisch Systeme aller Qualitätsstufen von HDTV über ein verbessertes (EDTV) und das entsprechend bisherigem Standard (SDTV) eingeführte 625-Zeilen-System bis zu einem System mit geringerer Auflösung (LDTV) umfaßt. Die wesentlichen Systemspezifikationen des europäischen DVB-Standards wurden bereits vom Technica/Module des DVB-Projektes ausgearbeitet und an das European Telecommunications Standards Institute (ETSI) zur Verabschiedung weitergeleitet.

Die nahe Zukunft der Fernsehtechnik wurde nun geprägt sein vom Nebeneinander der analogen Bildsignalübertragung mit der Option des 16:9-Bildseitenverhältnisses und einer kompatiblen digitalen Tonsignalübertragung sowie einer rein digitalen Übertragung eines Multiplex-Datensignales, dem der Decoder die notwendigen Anteile zur Rückgewinnung der Bild- und Toninformation entnimmt.

Dieser rapiden Entwicklung folgend, war es notwendig, auf diese neuen Verfahren ausführlich einzugehen. Dabei zeigte sich sehr bald, daß dadurch der Umfang dieser Dokumentation zu sehr erweitern würde. So kam es zum Entschluß, auf einige Kapitel aus der „Fernsehtechnik - Von der Kamera zum Bildschirm" zu verzichten und dem Werk den neuen Untertitel „Übertragungsverfahren für Bild, Ton und Daten" zu geben. Weggelassen wurden die Kapitel über Bildaufnahme- und Wiedergabe-Systeme, Studiogeräte und Sender sowie der Komplex des Fernsehempfängers. Nicht zuletzt war für diese Entscheidung auch ausschlaggebend, daß in diesen Bereichen die softwareunterstützte digitale Signalverarbeitung in Prozessoren beachtlichen Raum einnimmt und eine eingehende Beschreibung auch den Rahmen sprengen würde.

Ohne Signalprozessoren und hochintegrierte Speicher-Chips wären die neuen Verfahren in der Fernsehtechnik nicht vorstellbar, sei es nun die sende.- und empfangsseitige Signalverarbeitung bei dem neuen PALplus-System oder insbesondere bei der mit hoher Datenkompression verbundenen digitalen Fernsehsignalübertragung. Es wurde allerdings versucht, wieder in verständlicher Weise die Prinzipien und neuen Verfahren an Hand von umfangreich interpretierten Funktionsabläufen zu beschreiben.

Selbstverständlich kann dabei auf die Grundlagen der Bild.- und Tonsignalübertragung nicht verzichtet werden, und so beginnt die überarbeitete Dokumentation auch weiterhin mit der Übertragung der Helligkeitsinformation einer Schwarzweiß-Bildvorlage. In diesem Zusammenhang erscheinen auch im Literaturverzeichnis, das insgesamt auf Veröffentlichungen etwa der letzten zehn Jahre beschränkt wurde, noch einige klassische Bücher der von mir sehr geschätzten Professoren Thiele und Schönfelder.

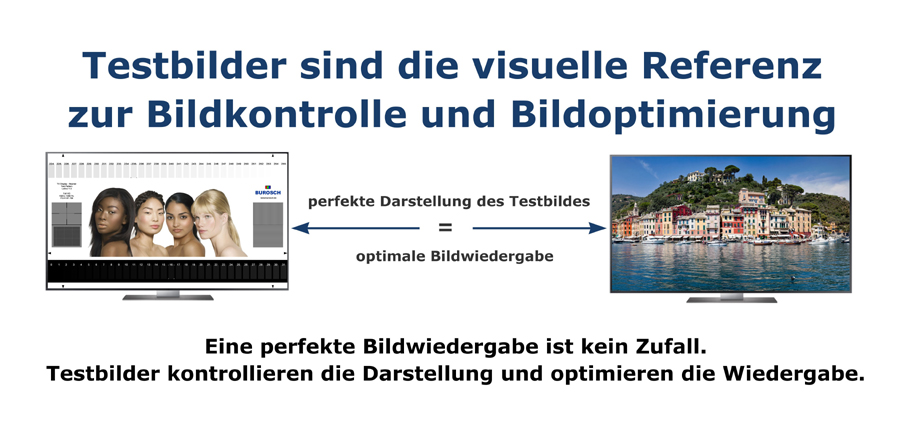

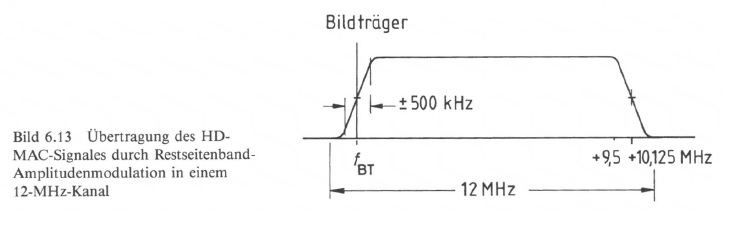

Burosch Ultra HD Referenz Testbild

1. Übertragung der Bild- und Toninformation

1.1 Prinzip der Bildübertragung

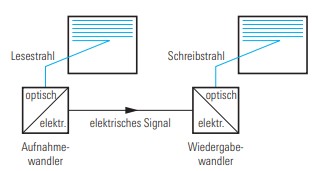

Fernsehen als ein Übertragungsverfahren der elektrischen Nachrichtentechnik, beruht auf der kontinuierlichen Umwandlung der Helligkeits- und Farbverteilung einer Bildvorlage in ein entsprechendes elektrisches Signal, das leitungsgebunden oder auf dem Funkweg dem Empfangssystem zugeführt und dort wieder in ein äquivalentes optisches Bild umgewandelt wird.

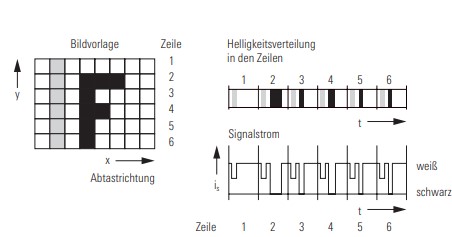

Sowohl von der Historie als auch von der Technik her baut das Fernsehen auf der Übertragung und Wiedergabe von Schwarzweißbildern, also der Helligkeitsverteilung der Bildvorlage, auf. Über ein optisch-elektrisches Wandlersystem wird dazu von den einzelnen Bildelementen, den Bildpunkten, nacheinander in bestimmter Folge ein elektrisches Signal erzeugt. Aus der zweidimensionalen geometrischen Zuordnung der Bildpunkte leitet sich so durch den Vorgang der Bildabtastung ein von der Zeit abhängiges Signal ab, dessen Momentanwert der Helligkeit des gerade abgetasteten Bildpunktes proportional ist. Empfangsseitig wird nach entsprechender Aufbereitung das elektrische Signal einem elektrisch-optischen Wandler, der Fernsehbildröhre, zugeführt und als ein Abbild der Helligkeitsverteilung der Bildvorlage wiedergegeben (Bild 1.1). Eine kontinuierliche Wiedergabe von bewegten Bildvorlagen erreicht man, wie beim Kinofilm, durch Übertragung einer entsprechenden Anzahl von Teilbildern.

1.1 Prinzip der Fernsehbildübertragung

Bildabtastung

Die Abtastung der Bildvorlage durch den Lesestrahl erfolgt zeilenweise von links nach rechts und von oben nach unten. Der Abtaststrahl wird dazu horizontal und vertikal abgelenkt. Der Vorgang läßt sich vergleichen mit der Bewegung des Gesichtsfeldes beim Lesen eines Textes von links nach rechts längs der Textzeilen und raschem Zurückspringen auf den Beginn der nächstfolgenden Zeile. Vom Ende der letzten Zeile am unteren Bildrand wird der Abtaststrahl zum Ausgangspunkt am linken oberen Bildrand zurück geführt und das Zeilenraster wiederholt durchlaufen. Die Ablenkung des Lese- bzw. Schreibstrahles in der horizontalen und vertikalen Richtung und die sich damit ergebende Rasterstruktur zeigt Bild 1.2.

Damit sich der Lesestrahl beim Bildwiedergabesystem und der Schreibstrahl gleichzeitig in richtiger Zuordnung über die Bildfläche bewegen, werden geeignete Synchronisierzeichen übertragen.

1.2 Zeitlicher Verlauf des Signalstroms bei zeileweiser Abtastung einer Bildvorlage.

Durch den Abtastvorgang werden die einzelnen Bildpunkte von der geometrischen in die zeitliche Verbindung gebracht. In der Darstellung nach Bild 1.3 wird vereinfachend davon ausgegangen, daß der Abtaststrahl in vernachlässigbar kurzer Zeit zum Anfang der nächsten Bildzeile zurückkehrt. Tatsächlich ist dazu, wie noch gezeigt wird, aber eine bestimmte Zeitdauer zu berücksichtigen.

1.3 Sehwinkel bei der Betrachtung eines Fernsehbildes

Im allgemeinen erhält man von einer Bildvorlage als Signalstrom eine sehr vielgestaltige Impulsfolge, die einen schwankenden zeitlichen Mittelwert aufweist, entsprechend dem mittleren Helligkeitswert der Bildvorlage. Dieser, sowie auch hochfrequente Signalkomponenten, bedingt durch feine Bilddetails, müssen dem Empfänger unverfälscht zugeführt werden. Daraus ergibt sich als untere Frequenzgrenze für das zu übertragende Bildsignal der Wert Null. Die obere Frequenzgrenze wird durch die Bildpunktauflösung bestimmt und im Abschnitt 1.2.1 berechnet.

Zeilenzahl

Die Qualität der Bildübertragung wird durch die Auflösung des Bildes, d. h. durch die Anzahl der Zeilen und Bildpunkte in der Zeile, bestimmt. Die Auflösung und damit die Bildschärfe ist um so besser, je höher die Zeilenzahl ist. Mit zunehmender Zeilenzahl wachsen aber auch die Anforderungen an das Übertragungssystem, so daß es gilt, einen vernünftigen Kompromiß zu finden.

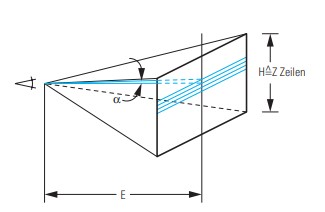

Eine Mindestzahl von Zeilen ist notwendig, damit die Rasterstruktur des wiedergegebe nen Bildes nicht störend in Erscheinung tritt. Diese kann jedoch nur im Zusammenhang mit dem Betrachtungsabstand des Fernsehbildes und dem Auflösungsvermögen des menschlichen Auges gefunden werden. Als optimaler Betrachtungsabstand wurde lange Zeit der etwa fünffache Wert der Bildhöhe angenommen. Bei diesem Betrachtungsabstand soll die Zeilenstruktur nicht mehr sichtbar sein, das heißt es soll die Grenze des Auflösungsvermögens des menschlichen Auges erreicht werden. Der Grenzwinkel a0, unter dem das Auge zwei Linien noch trennen kann, ist keine eindeutige Konstante. Er kann aber unter normalen Bedingungen mit a0 = 1,5' angenommen werden. Mit dem aus Bild 1.4 erkennbaren Ansatz

1.4 Aufteilung des Gesamtrasters beim Zeilensprungverfahren

und dem Wert tan = tan a0 z 4 · 10-4 erhält man eine Näherungsformel zur Berechnung der notwendigen Zeilenzahl Z mit

Das bedeutet mit einem vielfach angenommenen Wert von EIH = 5 eine Zahl von Z = 500 sichtbaren Zeilen. Dieses Ergebnis findet man auch annähernd in den eingeführten Standard-Fernsehsystemen.

Nach der in der Bundesrepublik Deutschland und vielen europäischen und außereuro päischen Ländern geltenden CCIR-Norm 1 Standard B und G sind 625 Zeilen für den gesamten Rasterdurchlauf festgelegt, wovon wegen der Austastung für den vertikalen Strahlrücklauf nur 575 Zeilen im sichtbaren Bildfeld liegen. Bei der US-Norm, CCIR Norm Standard M, mit 525 Zeilen verbleiben etwa 485 Zeilen für das sichtbare Bild (2).

Früher eingeführte Systeme arbeiteten mit 405 Zeilen (Großbritannien) oder 819 Zeilen (Frankreich). Wegen zu geringer Auflösung beziehungsweise wegen zu großer Frequenz bandbreite ist man jedoch überwiegend auf die 625-Zeilen-Norm übergegangen. Zeilen zahlen zwischen 500 und 600 haben sich auch aus anderen Gründen als optimal erwiesen: Die Leistungsfähigkeit der bis heute eingeführten optisch-elektronischen Systeme in bezug auf die Auflösung und den Störabstand bei den üblichen Beleuchtungsverhältnis sen liegt in dieser Größenordnung [3, 4, 5, 6, 7).

1 CCIR: Comite Consultatif International des Radiocommunkations, seit Dezember 1992 übergeführt in UIT/ITU-R, Union Internationale des Telecommunicationsllnternational Telecommunication Union - Radiocommunication Sector.

Bei einem Betrachtungsabstand von fünffacher Bildhöhe beträgt der vertikale Bildfeld winkel etwa 11°, der horizontale 15°, wegen des bisher geltenden Bildseitenverhältnisses von 4:3. Das Fernsehbild wird unter diesem geringen Bildfeldwinkel tatsächlich nur als Szenenausschnitt wahrgenommen. Ein zukünftiges hochauflösendes Fernsehsystem, HDTV (High Definition Television), wird mit seinen Parametern mehr dem menschlichen Gesichtsfeld angepaßt sein. Die Anzahl der sichtbaren Zeilen wird dabei auf das Zweifache erhöht (1152 sichtbare Zeilen im Vergleich zu 575 bzw. 576 sichtbaren Zeilen beim europäischen Standard) und das Bildseitenverhältnis (horizontal zu vertikal) auf 5,33:3 (16:9) vergrößert. Dies läßt einen geringeren Betrachtungsabstand (EIH = 2,5) zu und erweitert damit den Bildfeldwinkel bis zu etwa 25° in vertikaler bzw. 40° in horizontaler Richtung, womit der Eindruck eines szenenhaften Bildes zustande kommt [8]. Näheres zu HDTV siehe im Abschnitt 1.3 und Kap. 6.

Bildwechselfrequenz

Bei der Festlegung der Bildwechselfrequenz sind die physiologischen Eigenschaften des menschlichen Sehorgans zu berücksichtigen. Zunächst muß davon ausgegangen werden, daß zur Wiedergabe eines kontinuierlichen, schnellen Bewegungsvorgangs eine be stimmte Mindest-Teilbildfrequenz erforderlich ist, damit keine störenden Diskontinuitäten im Bild entstehen. Ein Wert von 16 Teilbildern je Sekunde stellt hier die untere Grenze dar. Beim Kinofilm arbeitet man mit 24 Teilbildern je Sekunde. Dieser Wert könnte auch beim Fernsehen übernommen werden, doch es wurde hier mit Rücksicht auf eine mögliche Verkopplung mit der Netzfrequenz eine Bildwechselfrequenz von fw = 25 Hz bei 50 Hz Netzfrequenz beziehungsweise fw = 30 Hz bei 60 Hz Netzfrequenz gewählt.

Eine Bildwechselfrequenz von 25 Hz reicht jedoch für eine flimmerfreie Bildwiedergabe nicht aus. Die subjektiv empfundene Flimmerstörung eines in der Helligkeit periodisch schwankenden Bildfeldes hängt von verschiedenen Faktoren ab, vornehmlich aber von der Frequenz der Helligkeitsschwankung und dem Verhältnis der Hellzeit zur Dunkel zeit. Die Flimmergrenzfrequenz liegt nun wesentlich über dem Grenzwert der Teilbildwechselfrequenz für kontinuierliche Bildwiedergabe. Unter den üblichen Betrachtungs bedingungen des Fernsehbildes rechnet man mit einer Bildschirm-Leuchtdichte von etwa 60 bis 80 cd/m2, wobei die Flimmergrenzfrequenz dann zwischen 50 und 60 Hz liegt.

Es besteht somit ein erheblicher Unterschied zwischen der für kontinuierliche Bewe gungsauflösung notwendigen Bildwechselfrequenz und der Flimmergrenzfrequenz. Dieses Problem lag auch schon beim Einführen des Kinofilms vor und wurde dort ohne eine Erhöhung der Teilbildfrequenz gelöst. Durch eine sogenannte Flimmerblende wird die Projektion jedes Einzelbildes einmal unterbrochen, wobei der Eindruck der doppelten Bildwechselfrequenz entsteht.

Beim Fernsehen verstärkt sich der Eindruck der Helligkeitsschwankung gegenüber dem Kinofilm sogar noch durch das zeilenweise Schreiben des Bildes. Wenn auch durch das Nachleuchten des Leuchtstoffes am Bildschirm eine gewisse Verringerung des Flimmereffektes erreicht werden kann, so darf dies nicht über die Zeitdauer einer Abtastperiode ausgedehnt werden, da sonst Störungen durch Nachziehen bei raschen Bewegungen auf treten. Insgesamt betrachtet muß somit die Wechselfrequenz für ein Teilbild auf mindestens 50 Hz erhöht werden.

Zeilensprungverfahren

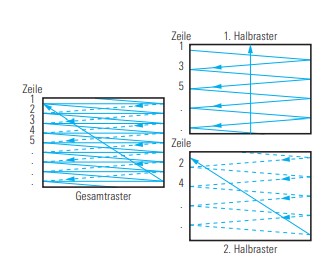

Die Bildwechselfrequenz auf den doppelten Wert zu erhöhen wäre zwar eine Möglichkeit, um das Flimmern zu vermeiden. Es hätte aber gleichzeitig eine Erweiterung der notwendigen Übertragungsbandbreite um den Faktor zwei zur Folge. Ähnlich wie beim Kinofilm hat man auch beim Fernsehen eine einfache aber geniale Lösung mit dem Zeilensprungverfahren gefunden. Versuche ergaben nämlich, daß die Wechselfrequenz auf kleine Bildbereiche bezogen relativ niedrig sein kann, wenn nur das Zeilenraster genügend oft geschrieben wird.

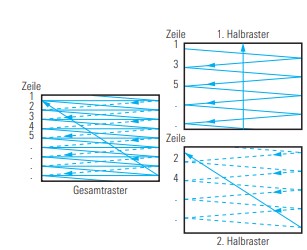

Nach dem Zeilensprungverfahren, auch Zwischenzeilenverfahren genannt, werden die Z Zeilen des gesamten Rasters auf zwei Halbraster aufgeteilt, die ineinander verschachtelt sind und die zeitlich nacheinander übertragen werden. Jedes Halbraster enthält Z/2 Zeilen und läuft in der Zeit t = Tw/2 = 1/2fw ab. Das bedeutet, daß dem ersten Halbraster die Zeilen 1, 3, 5, ... und dem zweiten Halbraster die Zeilen 2, 4, 6, ... nach der geometrischen Zeilennumerierung zugeschrieben werden (Bild 1.5).

1.5 Verkopplung der Horizontal- und Vertikalablenkfrequenz beim Zeilensprungverfahren nach dem CCIRStandard

Der Wechsel vom ersten zum zweiten Halbraster erfolgt bei ungerader Zeilenzahl, zum Beispiel mit Z = 625, am Ende des ersten Halbrasters nach Durchlaufen einer halben Zeile. Damit erübrigt sich ein besonderes Hilfssignal zum periodischen Versatz der bei den Halbraster und es ist stets die Voraussetzung geschaffen, daß die Zeilen des zweiten Halbrasters in den Zwischenräumen des ersten Halbrasters liegen und somit ein gleichmäßig verteiltes Gesamtraster entsteht.

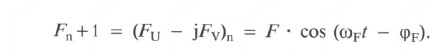

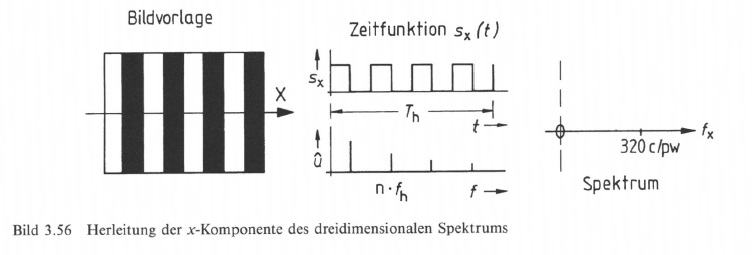

An Stelle von 25 Vollbildern je Sekunde mit je 625 Zeilen werden also 50 Halbbilder mit je 312 1/2 Zeilen übertragen. Es ergibt sich somit eine Halbbildwechselfrequenz, auch als Rasterwechselfrequenz oder Vertikalfrequenz fv bezeichnet, von fv = 50 Hz. Die Periodendauer des Halbbildwechsels beziehungsweise der Vertikalablenkung beträgt Tv = 1/fv = 20 ms.

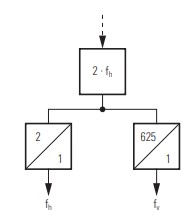

Für die Standards B und G der CCIR-Norm leitet sich mit 625 Zeilen je Vollbild oder 312 1 /2 Zeilen je Halbbild hieraus eine Zeilenwechselfrequenz (Zeilenfrequenz) oder Horizontalfrequenz fh ab mit dem Wert

fh = 625 · 25 Hz = 312 1/2 · 50 Hz = 15625 Hz.

Die Periodendauer des Zeilenwechsels beziehungsweise der Horizontalablenkung beträgt Th = 1 /fh = 64 µs. Es ist in der Fernsehtechnik üblich, die Periodendauer einer Zeile durch den Buchstaben H anzugeben. Im Fall der CCIR-Norm B, G entspricht somit H = Th = 64 µs.

Horizontal- und Vertikalablenkfrequenz müssen synchron und phasenstarr miteinander verkoppelt sein. Man erreicht dies beim Zeilensprungverfahren durch Ableitung der bei den Frequenzen aus der doppelten Horizontalfrequenz 2 ·fh (Bild 1.6).

1.6 Auflösung der Bildvorlage durch das Zeilenraster

Die Anwendung des Zeilensprungverfahrens erhöht zwar die Rasterwechselfrequenz auf 50 Hz und damit in den Bereich der Flimmergrenzfrequenz. Es verbleibt aber, insbeson dere in Bildpartien mit großer Helligkeit, ein 50-Hz-Flächenflimmern. An horizontalen Kanten mit hohem Kontrast versagt das Zeilensprungverfahren ganz. Hier entsteht ein 25-Hz-Kantenflimmern. Eine Beseitigung dieser Flimmereffekte kann nur über eine Erhöhung der Bildwiedergabefrequenz auf einen Wert von 75 Hz oder 100 Hz erfolgen. Dies ist heute möglich mittels digitaler Bildspeichersysteme.

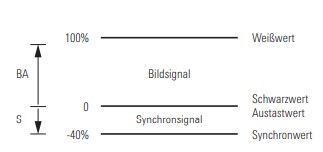

1.2 BAS-Signal

Unter dem BAS-Signal versteht man das (für Schwarzweiß-Bildübertragung) komplette Fernsehsignal, das sich aus dem eigentlichen Bildsignal (B), dem Austastsignal (A) und dem Synchronsignal (S) zusammensetzt. Das Bildsignal enthält die zeilenweise gewonnene Information über die Helligkeitsverteilung der zu übertragenden Bildvorlage.

1.2.1 Bandbreite des Bildsignales

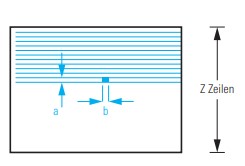

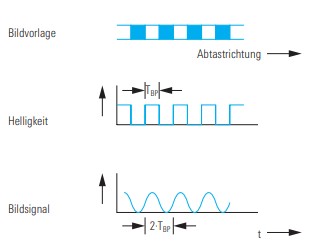

Das vom Bildsignal oder Videosignal belegte Frequenzband wird durch die Bildpunkt auflösung in horizontaler Richtung und durch die Zeilenzahl bestimmt. Die Auflösung in vertikaler Richtung ist wegen der Zeilenstruktur diskontinuierlich und quantisiert, in horizontaler Richtung ergibt sich durch die kontinuierliche Bewegung des Abtaststrahles eine Verschleifung von Hell-Dunkel-Kanten. Zur Berechnung der höchsten im Bildsignal vorkommenden Frequenzkomponente, der maximalen Bildfrequenz, wird der Einfachheit halber zunächst von gleicher Auflösung des Bildes in horizontaler und vertikaler Richtung ausgegangen, das heißt die Bildpunktbreite b wird gleich dem Zeilenabstand oder der Zeilenbreite a angenommen (Bild 1.7). Wechseln sich ein heller und ein dunkler Bildpunkt aufeinanderfolgend und von Zeile zu Zeile versetzt ab, dann erhält man ein Schachbrettmuster, das die höchstmögliche Auflösung der Bildvorlage wiedergibt. Man spricht deshalb im Zusammenhang mit der maximalen Bildfrequenz auch von der ,,Schachbrettfrequenz".

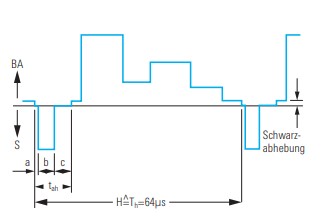

1.7 Periodendauer der Horizontal- und Vertikalablenkung mit Rücklaufzeiten

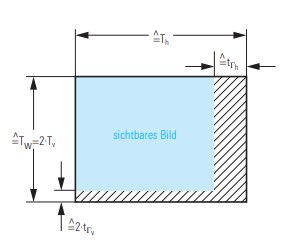

Der Abtaststrahl muß nach Durchlaufen jeder Zeile und jedes Teilbildes wieder zurück geführt werden. Dazu sind Rücklaufzeiten erforderlich. Während des Strahlrücklaufes werden sowohl der Lesestrahl in dem Aufnahmewandler als auch der Schreibstrahl in der Bildröhre dunkel gesteuert. Die notwendigen Rücklaufzeiten tr,h und tr,v innerhalb der Periodendauer Th der Horizontalablenkung beziehungsweise Tv der Vertikalablenkung sind in Bild 1.8 im zeitlichen Verlauf der Ablenkströme angegeben. Die Rücklaufzeiten müssen innerhalb der Intervalle ta,h beziehungsweise ta,v der Strahlaustastung liegen. Für diese sind nach der CCIR-Norm bestimmte Zeiten festgelegt.

1.8 Durch Rücklaufzeiten reduzierte Rasterfläche

In den CCIR-Standards B, G beträgt die Zeitdauer der Horizontalaustastung

ta,h = 12 ± 0,3 µs,

entsprechend 18,75 % von der Periodendauer Th und die Zeitdauer der Vertikalaustastung

ta,v = 25 ·H + ta,h = 1,612 ms,

entsprechend etwa 80 % von der Periodendauer Tv.

Von der gesamten Zeilenperiodendauer Th steht somit zur Übertragung des Bildinhaltes einer Zeile nur die Zeit Th· (1 -0, 1875) = 52 µs und von der gesamten, der Perioden dauer Tw = 2 · Tv zugeordneten Zeilenzahl Z nur der Anteil Z · (1-0,08) = 575 Zeilen für die Bildübertragung zur Verfügung. Dies läßt sich durch eine reduzierte Rasterfläche für das sichtbare Bild ausdrücken (Bild 1.9).

1.9 Verschleifung des Bildsignals als Folge des endlichen Strahldurchmessers

Für das sichtbare Bild ist ein rechteckiges Format mit dem Seitenverhältnis B / H = 4/3 festgelegt. Bei gleicher Auflösung in horizontaler und vertikaler Richtung berechnet sich hieraus eine Anzahl von

4/3 · 625 · (1-0,08) 767 Bildpunkte je Zeile

und von

4/3 · 625 · (1-0,08) · 625 · (1-0,08) 440833 Bildpunkte

je Bild.

Diese Anzahl von Bildpunkten wird übertragen in einer Zeit von

64 µs · (1-0,1875) · 625 · (1-0,08) = 29,9 ms.

Für die Zeit TBP zum Durchlaufen eines Bildpunktes ergibt sich dann

T BP = 29,9 ms 0,067

440833 = µs.

Die höchste Bildfrequenz tritt auf, wenn helle und dunkle Bildpunkte aufeinanderfolgen (Bild 1.10). Das Bildsignal weist dann eine Periodendauer auf von

TB = 2 · TBP = 0,135 µs

1.10. Horizontal-Austastsignal und Bildung des BA-Signals

Wegen des endlichen Durchmessers des Abtaststrahles und der damit verbundenen Verschleifung des Hell-Dunkel-Überganges genügt es, die Grundschwingung des rechteck-förmigen idealisierten Signalverlaufes zu übertragen. Dies führt zu einer höchsten vor kommenden Bildfrequenz von

Die Grenze der Auflösung in vertikaler Richtung ist durch die Zeilenstruktur gegeben. Bei voller vertikaler Auflösung und fehlender Vorfilterung würde durch den zeilenweisen Abtastvorgang ein Übersprechen im Spektrum auftreten, das zu Schwebungseffekten im wiedergegebenen Bild führen könnte. Es wird deshalb durch eine „optische Unschärfe" die Auflösung in vertikaler Richtung etwas reduziert. Um die Auflösung in horizontaler und vertikaler Richtung wieder anzugleichen, wird eine Reduktion der Horizontalauf lösung und damit der notwendigen Übertragungsbandbreite um etwa den Faktor 2/3 vorgenommen. Dieser Faktor wird als KELL-Faktor bezeichnet, unter Bezugnahme auf R. D. KELL, der sich eingehend mit dem Problem der Fernsehbildzerlegung beschäftigt hat [3, 4, 6). Man kommt so letztendlich auf eine Bandbreite des Videosignales von Bvideo = 5 MHz

Dieser Wert ist in der CCIR-Norm B, G festgelegt Man erkennt, dass die Rasterwechselfrequenz fv linear und die Zeilenzahl Z quadratisch in die maximale Bildfrequenz eingeht. Dies gewinnt insbesondere bei dem hochauflösen den Fernsehsystem HDTV an Bedeutung, siehe dazu Abschnitt 1.3.2.

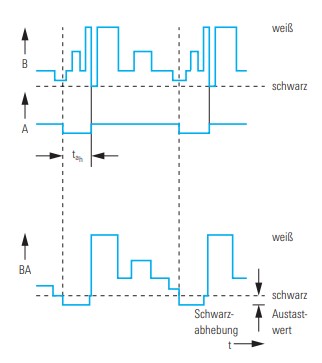

1.2.2 Austastsignal

Während des horizontalen und vertikalen Strahlrücklaufes wird das Bildsignal in seinem zeitlichen Verlauf unterbrochen, es wird „ausgetastet". Der Signalpegel wird auf einem definierten Austastwert festgehalten, um ein Überschreiben des aus dem Hinlauf aufgenommenen Bildinhalts zu vermeiden. Der Austastwert liegt geringfügig unter dem Schwarzwert des Bildsignales. Die Differenz zwischen Schwarzwert und Austastwert wird als Schwarzabhebung bezeichnet. Zugunsten einer besseren Ausnutzung des Aus steuerbereiches wird jedoch meistens auf die Schwarzabhebung verzichtet. Dies sieht auch der letzte Stand der CCIR-Norm B, G vor.

Die Austastung des Bildsignales wird durch das Austastsignal vorgenommen, das sich aus den zeilenfrequenten Horizontal-Austastimpulsen mit der Dauer, ta.h = 12 µs und den im Rhythmus des Halbbildwechels erscheinenden Vertikal-Austastimpulsen mit der Dauer ta,v = 1,612 ms zusammensetzt. Das so modifizierte Bildsignal wird dadurch zum BA-Signal (Bild 1. 11).

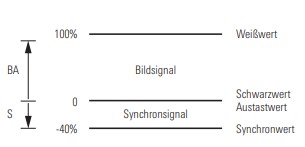

1.11 Aussteuerbereich des BAS-Signals

1.2.3 Synchronsignal

Das empfangsseitig auf der Fernsehbildröhre geschriebene Zeilenraster muß synchron mit dem sendeseitigen Zeilenraster ablaufen. Dazu werden neben dem Bildsignal noch Synchronimpulse erzeugt und übertragen. Sie steuern gleichermaßen die Ablenkeinrich tungen beim Aufnahme- und Wiedergabewandler. Eingebracht werden die Synchronimpulse während des horizontalen und vertikalen Strahlrücklaufes, wo das Bildsignal aus getastet wird. Pegelmäßig liegt das Synchronsignal unter dem Austastwert, es entspricht damit einem Signalniveau „schwärzer als schwarz" ( Bild 1.12).

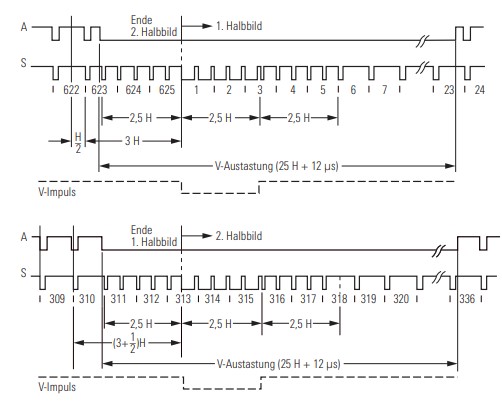

1.12 Horizontal-Synchronsignal

Die Impulse zur Synchronisierung der Horizontal- und Vertikalablenkung müssen ein deutig unterscheidbare Merkmale aufweisen. Innerhalb des wertmäßig zugeordneten Spannungsbereiches ist dies möglich durch die unterschiedliche Folgefrequenz und durch verschiedene Impulsdauer.

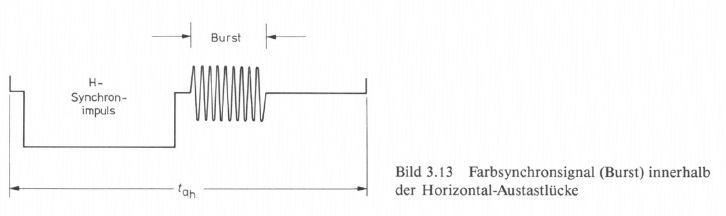

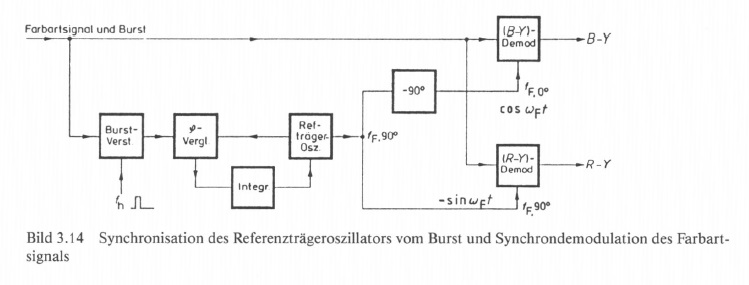

Nach der CCIR-Norm B, G beginnt der Horizontal-Synchronimpuls 1,5 µs nach dem Horizontal-Austastimpuls (Bild 1.13). Diese sogenannte vordere Schwarzschulter (c) bietet die Sicherheit, daß der Zeilenrücklauf bestimmt in die Horizontal-Austastlücke fällt. Die Vorderflanke des 4,7 µs (d) breiten Horizontal-Synchronimpulses ist bestimmend für das Einsetzen der Synchronisierung. Die hintere Schwarzschulter (b- d) dient als Bezugspegel. Sie wird aber auch für die Übertragung des zusätzlichen Farbsynchron signales (Burst) beim NTSC- und PAL-Farbfernsehsystem genutzt. Der Horizontal Synchronimpuls wird im Bildwiedergabegerät über ein Differenzierglied (Hochpaß) aus dem Synchronsignalgemisch ausgesiebt. Damit bleibt das Kriterium der Synchronisation durch die Vorderflanke erhalten.

Innerhalb der Vertikal-Austastlücke wird der Vertikal-Synchronimpuls übertragen. Er ist mit einer Dauer von 160 µs (2,5 H) wesentlich länger als der Horizontal-Synchronimpuls. Damit während dieser Zeit kein Ausfall der Horizontal-Synchronisierung erfolgt, wird der Vertikal-Synchronimpuls kurz unterbrochen. Die Unterbrechung geschieht

1.13 Vertikal-Synchronsignal mit Vor- und Nachimpulsen

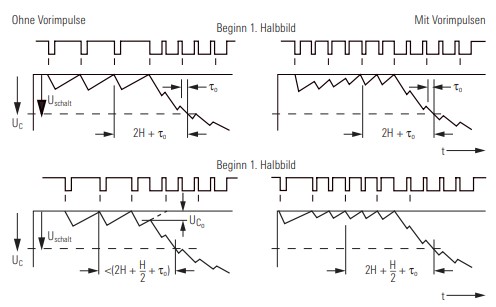

wegen des Halbzeilenversatzes der beiden Teilraster im Abstand von H/2. In dem Bild 1.14, mit der Darstellung der kompletten Vertikal-Synchronimpulsfolge im ersten und zweiten Halbbild, sind die für die Horizontal-Synchronisierung maßgebenden Impuls flanken markiert. Das Zeilensprungverfahren bedingt auch, daß der Vertikal-Synchron impuls um H/2 in bezug auf den letzten Horizontal-Synchronimpuls von einem Halbbild zum anderen verschoben ist.

1.14 Bedeutung der Vorimpulse: links: Integration des V-Synchronimpulses ohne Vorimpulse; rechts: Integration des V-Synchronimpulses mit Vorimpulsen

Das Kriterium für die Synchronisierung der Vertikalablenkung gewinnt man durch Integration des vollständigen Synchronsignales, bei der wegen der Tiefpaßwirkung des Integriergliedes und der längeren Impulsdauer des Vertikal-Sychronimpulses nur dieser den entscheidenden Beitrag liefert.

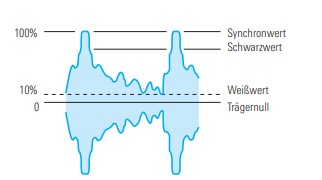

1.15 Negative Amplitudenmodulation des hochfrequenten Bildträgers durch das BAS-Signal

Die dem Vertikal-Synchronimpuls vorangehenden Horizontal-Synchronimpulse ergäben jedoch wegen des H/2-Versatzes in den beiden Halbbildern unterschiedliche Anfangsbedingungen für den Integrationsvorgang (Bild 1.15, links). Dies könnte zu einem fal schen Einsetzen der Vertikal-Sychronisierung und damit zu einer Paarigkeit der Rasterzeilen führen. Es werden deshalb dem eigentlichen Vertikal-Synchronimpuls fünf schmale (2,35 µs) Ausgleichsimpulse, die Vorimpulse oder Vortrabanten, jeweils im Abstand von H/2 vorausgeschickt, damit in jedem Halbbild gleiche Anfangsbedingungen für die Integration herrschen (Bild 1.15, rechts). In ähnlicher Weise sorgen fünf Nachimpulse für eine gleichmäßige Rückflanke der integrierten Vertikal-Teilimpulse.

Zur Zählweise der Zeilen in Bild 1.14 ist noch folgendes zu sagen: In der Fernsehtechnik ist es üblich, entgegen der Aufteilung in ungeradzahlige und geradzahlige Zeilen gemäß Bild 1.5, die aufeinanderfolgend ablaufenden Zeilen durchgehend zu numerieren. Das erste Halbbild beginnt bei der Vorderflanke des Vertikal-Synchronimpulses mit Zeile 1 und es weist 312 1 /2 Zeilen auf. Davon fallen die ersten 22 1 /2 Zeilen in die Vertikal Austastlücke. Das zweite Halbbild beginnt nach 312 1/2 Zeilen in der Mitte der 313. Zeile bei der Vorderflanke des Vertikal-Synchronimpulses und endet mit der 625. Zeile. Danach wiederholt sich die Zählweise im Rhythmus von zwei Halbbildern.

Bild 1.16 zeigt im doppelt-logarithmischen Maßstab das Frequenzspektrum des voll ständigen Synchronsignales im Frequenzbereich bis 50 kHz. Gestrichelt ist in dieser Darstellung die Trennung der Spektralkomponenten in ihre wesentlichen Anteile unterhalb und oberhalb von 5 kHz zur Gewinnung des Vertikal- und Horizontal-Synchronanteils. Die Trennung erfolgt durch einfache RC-Tief- bzw. Hochpässe.

Das Synchronsignal wird an der Videosignalquelle pegelgerecht dem BA-Signal zugesetzt. Man erhält so das BAS-Signal. Der Normspannungswert für das BAS-Signal beträgt in der Studio- und Fernsehmeßtechnik 1 Volt (Spitze-Spitze-Wert), wobei auf den BA-Anteil 70 % (0,7 V) und auf den S-Anteil 30 % (0,3 V) entfallen. Als Bezugspegel kann der Austastwert gelten (nach CCIR-Norm) mit dem Weißwert bei 100 % und dem Synchronwert bei -43 % oder der Synchronpegel, wobei dann der Austastwert bei 30 % vom Weißwert liegt (siehe dazu Bild 1.12). Der Bezugswiderstand in der Videotechnik ist 75 Ohm.

Eigenschaften eines HDTV-Signales

Die Bildwiedergabequalität des bisher behandelten und eingeführten Fernsehsystems ist, besonders im Vergleich zum Kinofilm, noch nicht optimal. Als Schwachpunkte wären anzuführen

- die mäßige Detailauflösung

- ein störendes Zeilenflimmern

- das 50 Hz Großflächenflimmern bei großer Bildhelligkeit

- das 25 Hz Flackern an horizontalen Kanten

und einige Schwächen im Zusammenhang mit der Farbbildwiedergabe, auf die hier noch nicht eingegangen werden kann.

Darüber hinaus bietet das Kinobild mit seiner großen Fläche ein besseres Realitätsemp finden, insbesondere bei einem breiten Bildformat. Das menschliche Gesichtsfeld weist einen Betrachtungswinkel von etwa 150 ° in der vertikalen und etwa 200 ° in der horizontalen Richtung auf. Im Abschnitt 1.1.2 wurde schon erwähnt, daß bei dem bisher ange nommenen Betrachtungsabstand von der fünffachen Bildhöhe der Bildfeldwinkel nur 11 ° beziehungsweise 15 ° beträgt. Ein der Realität näher liegender Eindruck des Fernsehbildes unter einem vertikalen Betrachtungswinkel von mindestens 25 °, bei einem Betrachtungsabstand von etwa 2,5 facher Bildhöhe, erfordert nach GI. (1.2) mindestens 1000 sichtbare Zeilen.

Zeilenzahl

In Anlehnung an die bisherige europäische CCIR Norm mit insgesamt 625 Zeilen ging man bei der Festlegung der Parameter für ein hochauflösendes Fernsehverfahren (High Definition Television, HDTV) zunächst von einer Verdopplung der Zeilenzahl aus. Wegen des im Übertragungskanal weiterhin beizubehaltenden Zeilensprungverfahrens und der dabei zweckmäßigerweise ungeraden Zeilenzahl wurde nach einem deutschen Vorschlag ursprünglich ein Wert von 1249 Zeilen als Arbeitsstandard festgelegt. Mit Rücksicht auf ein wirklichkeitsnäheres Bild wurde das Bildformat auf 5:3 geändert.

In den Ländern, wo nach dem CCIR Standard M eine Zeilenzahl von 525 eingeführt ist, insbesondere in Japan und USA, wurde jedoch eine andere Zeilenzahl für ein Hochzeilen-Fernsehen gewählt. Wohl aus einem Mittelwert zwischen 1050 und 1250 Zeilen ergab sich der Wert von 1125 Zeilen. Gleichzeitig wurde nach diesem Standard die Halbbildwechselfrequenz von 60 Hz beibehalten, was einer weitgehenden Unterdrückung von Flimmerstörungen entgegenkommt. Auf Drängen amerikanischer Rundfunkanstalten wurde das Bild-Seitenverhältnis noch auf 5,33:3 verändert. So ergaben sich für den von der japanischen Rundfunkanstalt NHK (Nippon Hoso Kyokai) aufgestellten Vorschlag für eine HDTV-Norm folgende Parameter:

- 1125 Zeilen Zeilensprungverfahren

- Bild-Seitenverhältnis 5,33: 3 (16:9)

- Rasterwechselfrequenz 60 Hz, was eine Zeilenfrequenz von 33750 Hz ergibt.

Der Wunsch - damals 1995 - nach einem weltweiten HDTV Fernseh Standard ist zwar sehr ausgeprägt, um möglichst aufwendige Normwandlungen und damit verbundenen Qualitätsverlust zu vermeiden. Die vielen Bemühungen scheiterten aber letztlich doch an nationalen Interessen. Es zeichnete sich zunächst ein deutlicher Vorsprung des NHK-Standards ab. Die Entwicklung in USA verlief jedoch dann wieder zugunsten von 1050 Zeilen wegen der besseren Kompatibilität zu dem 525 Zeilensystem [6, 9, 10, 11].

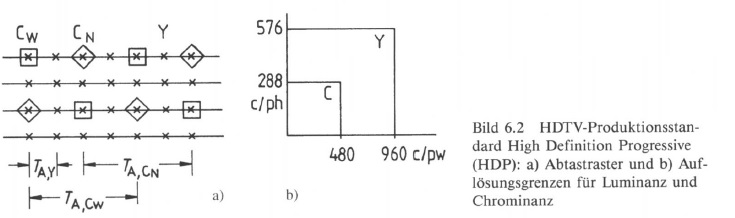

Das größte Hindernis auf dem Weg zu einer weltweiten Einigung auf einen gemeinsamen Standard liegt in den unterschiedlichen Rasterwechselfrequenzen von 50 Hz und 60 Hz. Im Jahr 1987 haben sechs europäische Länder beim CCIR einen eigenständigen Vorschlag für eine HDTV Produktionsnorm eingebracht. Im Projekt EUREKA EU95 wur den folgende Parameter definiert [11, 12]:

- 1250 Zeilen, davon 1152 aktive Zeilen

- Bildwechselfrequenz 50 Hz progressive Abtastung Bildseitenverhältnis 16:9

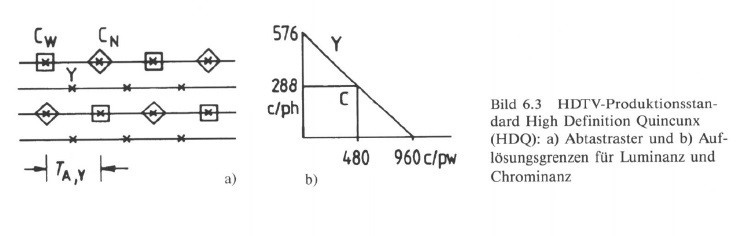

Die Anwendung der progressiven Abtastung, d. h. kein Zeilensprung, bringt wesentliche Vorteile bei der Normwandlung. Geometrisch benachbarte Zeilen sind stets auch zeitlich aufeinanderfolgend. Damit reduziert sich bei einer nachfolgenden Bildsignalverarbeitung der Speicheraufwand für Interpolationsprozesse.

Mit Übergang auf progressive Abtastung bei gleicher Bildwechselfrequenz erhöht sich allerdings die Bandbreite des Videosignales auf das Zweifache. Wie später im Abschnitt 6.1 noch detailliert dargestellt, gibt es auch bei der progressiven Abtastung noch eine bandbreitensparende Variante, die Quincunx-Abtastung, auf die vielfach zurückgegangen wird.

Während in Japan auch heute noch am NHK-Standard mit 1125 Zeilen festgehalten wird, bahnte sich in den USA eine völlig andere Entwicklung an. Ausgelöst durch die 1992 getroffene Entscheidung für ein digitales HDTV System wurde von dem „Grande Alliance"-Gremium, bestehend aus Forschungsinstituten und Industrieunternehmen, nicht ein HDTV Standard, sondern eine „HDTV Standard Familie" mit sechs möglichen Varianten festgelegt.

Basierend auf quadratischen Bildpunkten, wegen der engen Verbindung zur Computer technik, wurden zwei Auflösungsformate mit 1280 (H) x 720 (V) Bildpunkten bzw. 1920 (Horizontal) x 1080 (Vertikal) Bildpunkten entsprechend den Zeilenzahlen von 788 bzw. 1182 (Gesamtzeilenzahl) und einem Bildseitenverhältnis von 16: 9 definiert, mit möglichen Rasterwechselfrequenzen von 23,976 Hz/24 Hz, 29,97 Hz/30 Hz bzw. 59,94 Hz/60 Hz bei durchwegs progressiver Abtastung. Die Entscheidung für eine Sendenorm soll von den Programmanbietern getroffen werden, ein zukünftiger HDTV Empfänger stellt sich automatisch auf die bestmögliche Bildwiedergabequalität ein.

Bandbreite des Bildsignales

Die maximale Bildpunktfrequenz berechnet sich beim Zeilensprungverfahren nach GI. (1.3) bzw. mit Zak, = 1152 aktiven Zeilen bei insgesamt Z = 1250 Zeilen und mit Th,akt = 13,33 µs innerhalb der Zeilenperiodendauer von Th = 16 µs sowie dem Bildseitenverhältnis von B/H = 16/9 und der Bildwechselfrequenz fv = 50 Hz aus

1,16 Aufteilung des Gesamtrasters beim Zeilensprungverfahren

Bei progressiver Abtastung ergibt sich der zweifache Wert mit fs, max = 76,8 MHz. Unter Berücksichtigung eines KELL-Faktors von 0,65 erfordert dies eine Video-Übertragungsbandbreite mit 50 MHz.

Synchronsignal

Eine wesentliche Änderung erfolgt beim Synchronsignal. Wegen der digitalen Verarbeitung der breitbandigen HDTV-Signale ist eine hohe zeitliche Genauigkeit der Abtastwerte in bezug auf das Zeilenraster erforderlich. Die Festlegung des Zeilenbeginns mit der Vorderflanke des Horizontal-Synchronimpulses ist in diesem Fall wegen des Einflusses von Amplitudenänderungen und linearen sowie nichtlinearen Verzerrungen nicht mehr ausreichend. Es wurde deshalb ein neuer, sogenannter Drei-Pegel-Synchronimpuls definiert (Bild 1.17). Der Bezugspunkt für den Zeilenbeginn liegt nun beim Nulldurchgang des zweiseitig gerichteten Impulses. Damit wird man weitestgehend unabhängig von nichtlinearen Verzerrungen des Synchronimpulses. Das Spektrum dieses Impulses mit definierter Anstiegs- und Abfallzeit ist im wesentlichen auf tiefe Frequenzen im breitbandigen HDTV Signal begrenzt. Näherungsweise kann der Horizontal-Synchronimpuls nun als eine Schwingung mit etwa 1 MHz betrachtet werden.

1.17 Aussteuerbereich des BAS-Signals

Auch der Vertikal-Synchronimpuls wird gegenüber dem bisherigen System verändert. Er besteht aus zehn Teilimpulsen mit je 11,85 µs Dauer in fünf Zeilen innerhalb der Vertikal-Austastlücke, in die jeweils nach der halben Zeilendauer ein Horizontal-Synchronimpuls eingebracht ist [14]. Insgesamt muß ein HDTV-System jedoch unter dem Aspekt der Farbbildübertragung betrachtet werden. Es wird deshalb später nochmals in Kap. 6 darauf eingegangen.

Trägerfrequente Übertragung von analogem Standard-Bild- und Tonsignal

Die Übertragung des Bildsignales bzw. genauer des BAS-Signales sowie eines zum Bild gehörigen Begleittones erfolgt, abgesehen von der Verteilung im Studio und von einer digitalen Signalübertragung, durch Modulation einer hochfrequenten Trägerschwin gung. Prinzipiell gilt dies sowohl für drahtgebundene als auch für drahtlose Übertra gung. Von den Funk-Verwaltungsorganen wurden bestimmte Frequenzbereiche festgelegt, die ausschließlich oder vorwiegend zur Übertragung von Fernsehsignalen im Bereich des Rundfunk-Fernsehens dienen. Diese liegen im VHF-Bereich (40 bis 230 MHz) und im UHF-Bereich (470 bis 790 bzw. 860 MHz) und für die Satelliten-Übertragung im Frequenzbereich um 12 GHz. Darüber hinaus wurden für die Kabelverteilung noch Sonderkanäle im erweiterten VHF-Bereich bereitgestellt. Wegen der bis 5 MHz reichenden Modulationssignale ist eine hohe Trägerfrequenz erforderlich.

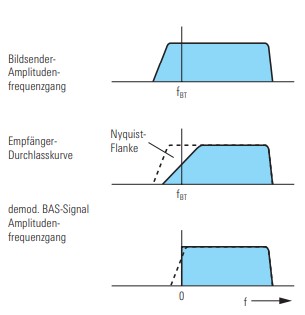

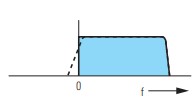

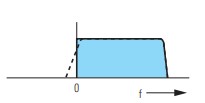

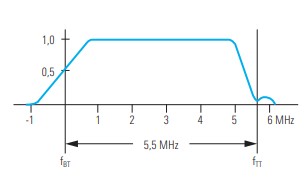

Bildsignalübertragung durch Restseitenband-Amplitudenmodulation

Beim Fernseh-Rundfunk in den bisher genutzten Frequenzbereichen (VHF und UHF) sowie in Übertragungssystemen, wo übliche Fernsehempfänger als Bildwiedergabegeräte verwendet werden, erfolgt die Bildsignalübertragung durch Amplitudenmodulation (AM) der hochfrequenten Trägerschwingung. Der Vorteil der Amplitudenmodulation liegt in der relativ geringen Bandbreite des Modulationsproduktes. Es entstehen bei dieser Modulationsart Seitenschwingungen im Abstand der Frequenz des modulierenden Signales oberhalb und unterhalb der Frequenz der Trägerschwingung. Mit der Bandbreite des BAS-Signales von Bvideo = B = 5 MHz wird damit ein hochfrequentes Übertragungsband mit der Bandbreite BAM = 2 · 5 MHz = 10 MHz beansprucht (Bild 1.18a).

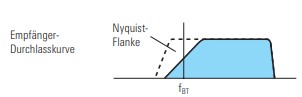

1.18 Korrektur des Amplitudenfrequenzgangs bei Restseitenband-Übertragung durch ein Nyquist-Filter

Prinzipiell könnte bei der Übertragung ein Seitenband unterdrückt werden, da ja der Signalinhalt in beiden Seitenbändern gleichermaßen enthalten ist. Man käme so mit der Einseitenband-Amplitudenmodulation (ESB-AM, EM) wieder auf eine Übertragungsbandbreite von BEM = 5 MHz (Bild 1.18b). Wegen des bis zu sehr niedrigen Frequenzen reichenden Modulationssignales und der deshalb notwendigen steilflankigen Filter zur Unterdrückung eines Seitenbandes, ergeben sich jedoch enorme Schwierigkeiten durch die Gruppenlaufzeitverzerrungen dieser Filter an der Grenze des Durchlaßbereiches.

Das Problem wird dadurch umgangen, daß an Stelle der Einseitenband-Amplitudenmodulation die Restseitenband-Amplitudenmodulation (RSB-AM, RM) angewendet wird. Dabei überträgt man ein Seitenband vollständig und das andere Seitenband nur teilweise mit relativ langsam abfallender Amplitude nach höheren Modulationsfrequenzen hin (Bild 1.18c). Die Einsparung an Frequenzbandbreite beträgt gegenüber der Zweiseitenband-Amplitudenmodulation (AM) immer noch etwa 4 MHz. Für Modulationssignale mit einer Frequenz bis 0,75 MHz liegt Zweiseitenband-Übertragung vor, bei höherfrequenten Signalkomponenten findet ein Übergang auf Einseitenband-Übertragung statt.

Empfängerseitig muß aber dafür gesorgt werden, daß die Signalkomponenten, die auch im Restseitenband enthalten sind, nach der Demodulation nicht mit doppelter Amplitude erscheinen gegenüber den Signalkomponenten, die nur in einem Seitenband übertragen werden. Es wird deshalb die Empfänger-Durchlaßkurve so ausgebildet, daß sich um die Frequenz des Bildträgers eine linear ansteigende bzw. abfallende Flanke ergibt, die sogenannte NYQUIST-Flanke (Bild 1.19).

1.19 NYQUIST-Flanke

1.20 Dämpfung

Den einzelnen Fernsehkanälen sind im VHF-Bereich (Bereich I und III) 7 MHz breite (CCIR-Norm, Standard B) und im UHF-Bereich (Bereich IV und V) 8 MHz breite (CCIR-Norm, Standard G) Frequenzbänder zugeteilt. Der hochfrequente Bildsender Amplitudenfrequenzgang innerhalb des 7 bzw. 8 MHz breiten Fernsehkanals ist in Bild 1.20 dargestellt. Die Dämpfung des unterdrückten Seitenbandes muß für Frequenzen unterhalb 1,25 MHz vom Bildträger mindestens 20 dB betragen.

Die Empfänger-Durchlaßkurve, bezogen auf den Hochfrequenzbereich (HF), mit der NYQUIST-Flanke zeigt Bild 1.21. Der Übergang vom Durchlaß- zum Sperrbereich erfolgt in einem Frequenzbereich von ±0,75 MHz um die Frequenz des Bildträgers. Bei der Bildträgerfrequenz selbst beträgt der Dämpfungsanstieg gegenüber dem voll übertragenen Seitenband 6 dB, das heißt, die Amplitude des Bildträgers wird auf 50 % ihres eigentlichen Wertes abgesenkt.

1.21 CCIR-Norm für den Bildsender-Amplitudenfrequenzgang

1.22 Negative Amplitudenmodulation des hochfrequenten Bildträgers durch das BAS-Signal

Die wesentliche Verstärkung und Selektion wird beim Fernsehempfänger im Zwischenfrequenzbereich (ZF) vorgenommen. Für den Bildträger ist eine Zwischenfrequenz von 38,9 MHz festgelegt. Durch die Frequenzumsetzung mit einer Oszillatorfrequenz ober halb der Empfangsfrequenz findet eine Umkehrung der Frequenzlage des übertragenen Seitenbandes statt (Bild 1.22). Ebenso erscheint die im Hochfrequenzbereich nach der CCIR-Norm, Standard Band G, um 5,5 MHz oberhalb der Bildträgerfrequenz liegende Tonträgerfrequenz im ZF-Bereich um 5,5 MHz unterhalb des Bildträgers bei 33,4 MHz. Die Empfänger-Durchlaßkurve für den ZF-Bereich gibt Bild 1.23 wieder.

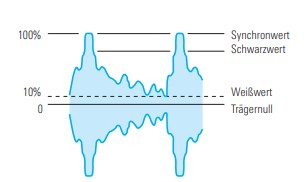

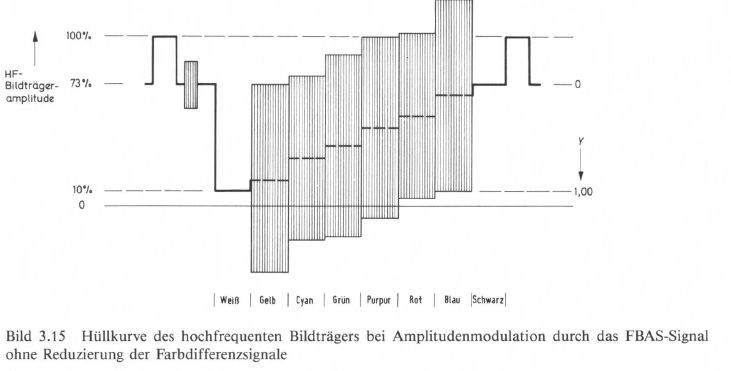

Die Modulation des hochfrequenten Bildträgers durch das BAS-Signal erfolgt als nega tive Amplitudenmodulation, das heißt, hellen Bildstellen entspricht eine niedrige Trägeramplitude und der Synchronimpuls ruft maximale Trägeramplitude hervor (Bild 1.24). Bezogen auf den Synchronspitzenwert mit 100 % liegt der Austastwert oder Schwarzwert bei 75 % und der Weißwert bei 10 bis 12,5 % [2]. Ein Restträger als Weißwert von 10 % ist notwendig wegen der Anwendung des Intercarrier-Tonträger-Verfahrens im Empfänger (siehe Abschnitt 1.4.2). Der Vorteil der Negativmodulation liegt unter anderem in einer günstigen Ausnutzung der Senderleistungsendstufe, weil die Maximalleistung nur kurzzeitig während der Synchronimpulse aufgebracht werden muß, sowie in der periodisch während der Synchronimpulse auftretenden Maximalamplitude des Trägers als Bezugswert für eine automatische Verstärkungsregelung im Empfänger. Zudem machen sich Störimpulse, die dem HF-Signal überlagert werden, am Bildschirm nur als dunkle Punkte bemerkbar.

1.23 Empfänger-Durchlasskurve

Die Anwendung der Restseitenband-Amplitudenmodulation bringt allerdings bei einfacher Hüllkurvendemodulation im Empfänger nicht übersehbare Verzerrungen mit sich. Im Videofrequenzbereich von Null bis 0,75 MHz werden beide Seitenbänder symme trisch zum Träger voll übertragen. Oberhalb von 1 MHz kann man davon ausgehen, daß nur ein Seitenband übertragen wird. Bei großem Modulationsgrad (helle Bildstellen) führt dies zu einer Verzerrung der Hüllkurve. Im Videofrequenzbereich oberhalb von 2,5 MHz gelangt nur der Grundschwingungsanteil des verzerrten demodulierten Signals zur Bildröhre, der allerdings durch die nichtlineare Verzerrung in seiner Amplitude reduziert sein kann. Zudem verschiebt sich der mittlere Helligkeitswert.

Dem begegnet man durch Anwendung der Synchrondemodulation. Der dazu notwen dige Referenzträger wird aus dem übertragenen RSB-AM-Modulationsprodukt durch eine Bandbegrenzung auf etwa ±0,5 MHz um den Bildträger und anschließende Amplitudenbegrenzung gewonnen. Diese Maßnahme erlaubt gleichzeitig, das Tonsignal weitgehend verzerrungsfrei und unabhängig vom Bildinhalt (insbesondere beim Farbfernsehsignal) zu gewinnen.

2. Hinzunahme der Farbinformation

Den bisherigen Ausführungen war die Übertragung der Helligkeitsverteilung einer Bildvorlage zugrunde gelegt. Die Entwicklung der Fernsehtechnik steuerte jedoch schon sehr bald in Richtung Farbbildübertragung und heute kann davon ausgegangen werden, daß mit dem Begriff Fernsehen selbstverständlich Farbfernsehen gemeint ist. Zur Wiedergabe eines farbigen oder bunten Abbildes der Vorlage muß aber neben der Helligkeitsverteilung noch eine zusätzliche Information über die Farbverteilung, daß heißt über die Farbart der einzelnen Bildpunkte übertragen werden. Dies setzt zunächst sendeseitig die Gewinnung dieser Farbinformation und deren Aufbereitung voraus und erfordert empfangsseitig auch eine Möglichkeit der Farbbildwiedergabe.

2.1 Problematik

Die Problematik der Farbbildübertragung beim herkömmlichen Fernsehen liegt darin, das beim Schwarzweiß-Fernsehen benutzte Übertragungsverfahren beizubehalten und die zusätzliche Farbinformation dem Empfänger möglichst innerhalb des Frequenzbandes des BAS-Signales und mit diesem in einem gemeinsamen Kanal zu übermitteln.

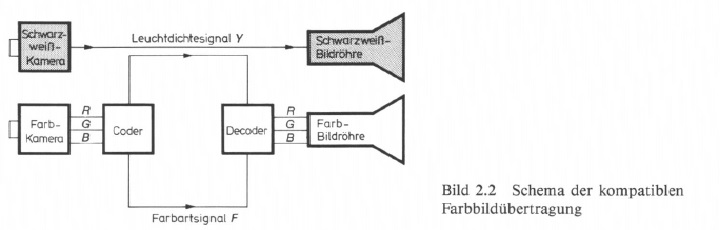

Für ein Farbfernsehsystem bedeutet dies, daß man ein in diesem System übertragenes Farbbildsignal so aufbereiten muß, daß von einem Schwarzweiß-Empfänger ein einwandfreies Helligkeitsbild wiedergegeben wird (Kompatibilität) und andererseits auch, daß ein Farbfernsehempfänger das Bildsignal von einer Schwarzweiß-Vorlage als einwandfreies unbuntes Bild wiedergibt (Rekompatibilität). Diese Forderungen können nur erfüllt werden, wenn aus der Farbbildvorlage

- eine Information über die Helligkeits- bzw. Leuchtdichteverteilung sowie

- eine Information über die Farbverteilung

gewonnen und entsprechend aufbereitet übertragen werden.

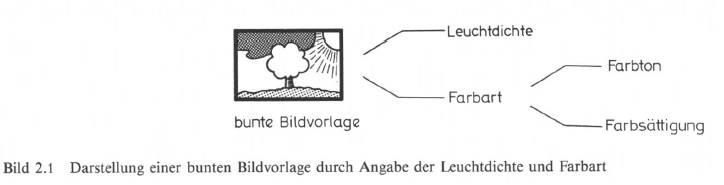

Eine bunte Bildvorlage kann beschrieben werden durch Helligkeit bzw. Leuchtdichte und durch die Farbart. Die Farbart ist gekennzeichnet durch den Farbton — bestimmt durch die dominierende Wellenlänge des Lichtes — und durch die Farbsättigung als ein Maß für die spektrale Reinheit, das heißt, für die Intensität der „Farbe" gegenüber dem Unbunten (Weiß) (Bild 2.1).

Während das Helligkeits- oder Leuchtdichtesignal direkt gewonnen werden kann, ist dies beim Farbartsignal nicht möglich. Es gibt keine technischen Einrichtungen, die selektiv auf Farbton oder Farbsättigung ansprechen. Bei der Erzeugung des Farbartsignales wird vielmehr von der Dreifarbentheorie nach HELMHOLTZ ausgegangen. Danach kann ein buntes Bild in drei Grund- oder Primärfarbanteile in den Farben Rot, Grün und Blau zerlegt werden. Über farbselektive Bildaufnahmewandler erhält man daraus die Farbwertsignale (R, G, B), die den Anteilen der drei Grundfarben proportional sind. Durch eine bestimmte Codierung gewinnt man aus diesen Signalen sowohl ein Leuchtdichtesignal als auch über einen weiteren Modulationsvorgang das Farbartsignal.

Auch bei der Farbbildwiedergabe werden die Farbwertsignale benötigt. Man erhält diese wiederum durch eine entsprechende Decodierung aus dem übertragenen Leuchtdichtesignal und dem Farbartsignal. Bild 2.2 zeigt das sich so ergebende Schema der kompatiblen Farbbildübertragung als Erweiterung der Schwarzweißbildübertragung.

2.2 Grundlagen der Farbenlehre und Farbmetrik

Das Verständnis eines Farbfernsehsystems setzt die Kenntnis einiger wesentlicher Gesetzmäßigkeiten und Darstellungen in der Farbenlehre voraus. Es werden deshalb in diesem Abschnitt die wichtigsten farbmetrischen Begriffe und Funktionen sowie verschiedene Darstellungsmöglichkeiten erläutert.

Als Licht wird der Teil der elektromagnetischen Strahlung bezeichnet, der vom menschlichen Auge wahrgenommen wird. Es umfaßt den Wellenlängenbereich von etwa 400 nm (violett) bis 700 nm (rot). Das von der Sonne ausgestrahlte weiße Licht besteht aus einer Vielzahl von Spektralfarben, die fließend ineinander übergehen. Spektralfarben sind voll gesättigte Farben. Durch Mischen mit unbuntem Licht erhält man ungesättigte Farben.

Eine farbige oder bunte Lichtstrahlung, die im Sehorgan eine bestimmte Farbempfindung hervorruft, nennt man Farbreiz. Diese Strahlung kann durch ihre spektrale Energieverteilung gekennzeichnet werden. Die Wahrnehmung durch das menschliche Sehorgan erfolgt über zwei Arten von lichtempfindlichen Elementen auf der Netzhaut des Auges: Stäbchen reagieren nur auf Helligkeitsunterschiede, während rot-, grün- und blauempfindliche Zäpfchen in einem relativ breiten Wellenlängenbereich auf die entsprechende Lichtstrahlung ansprechen. Über eine Mischung der drei Teilempfindungen entsteht der Farbeindruck.

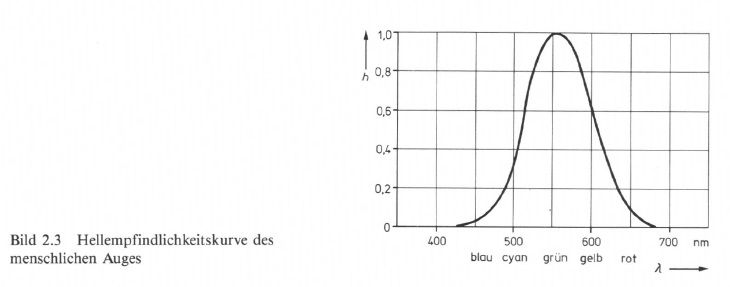

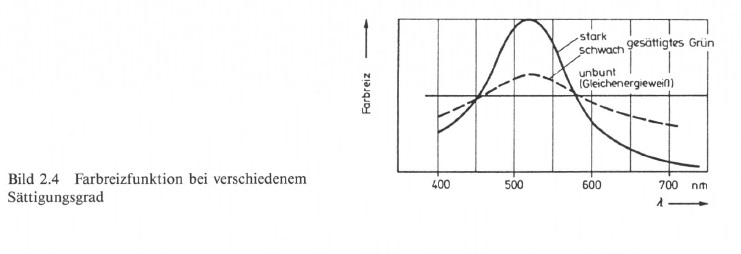

Die von der Wellenlänge der Strahlung abhängige Hellempfindung des menschlichen Auges wird durch die Augenempfindlichkeitskurve oder Hellempfindlichkeitskurve ausgedrückt (Bild 2.3). Sie gibt an, wie hell das an das Tageslicht adaptierte Auge die einzelnen Spektralfarben beurteilt, wenn diese mit gleicher Energie auf das Auge treffen.

Das Maximum der Kurve liegt bei einer Wellenlänge von 555 nm. Farben im Bereich von Grün werden hell, andere Farben, wie z. B. Blau, werden dunkel empfunden.

Auch beim Schwarzweiß-Fernsehen, wo ja nur die Helligkeitsverteilung einer bunten Bildvorlage übertragen wird, muss diese Hellempfindlichkeitskurve des Auges berücksichtigt werden. Dies geschieht über die spektrale Empfindlichkeit des Bildaufnahmewandlers und durch eventuelle Korrekturfilter. Ohne diese Korrekturmaßnahmen könnte ein unnatürlicher Bildeindruck hervorgerufen werden.

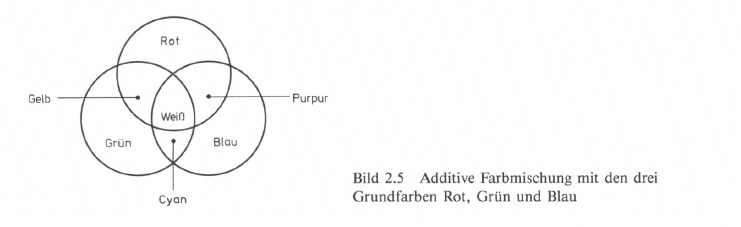

Die Farben von Gegenständen, die sogenannten Körperfarben, sind diejenigen Farben, die aus dem Licht, mit dem der Gegenstand bestrahlt wird, reflektiert werden. Meist handelt es sich bei den Körperfarben nicht um Spektralfarben, sondern um Mischfarben, die aus einer Anzahl von nahe beisammen liegenden Spektralfarben oder aus mehreren Gruppen von Spektralfarben gebildet werden. Die Farbreizfunktion gibt die zugehörige Spektralverteilung an (Bild 2.4). Beim Vorhandensein von mehreren Spektralfarben bildet sich durch additive Farbmischung eine Mischfarbe. Auch Weiß (Unbunt) kann als Mischfarbe entstehen. Typische Beispiele für eine additive Farbmischung aus den drei Grundfarben Rot, Grün und Blau zeigt Bild 2.5

Die von YOUNG und HELMHOLTZ im vorigen Jahrhundert angenommene und heute experimentell bestätigte Farbwahrnehmung des Sehorganes über drei Arten von farbempfindlichen Sinneszellen auf der Netzhaut des Auges liegt auch dem Gesetz der additiven Farbmischung zugrunde, das GRASSMANN im Jahre 1854 formulierte:

Jeder Farbreiz, der im Auge eine bestimmte Farbempfindung auslöst, wird durch das Zusammenwirken von drei Primärreizen mit bestimmten Anteilen in den Grundfarben Rot, Grün und Blau hervorgerufen.

Die Anteile der Grundfarben nennt man Farbwerte. Mathematisch läßt sich diese Gesetzmäßigkeit für einen bestimmten Farbreiz C, oder wie nach [36] in der Farbmetrik als Farbvalenz anzugeben ist, ausdrücken durch

![]()

Die Farbvalenz C wird durch additive Mischung aus den Primärvalenzen (R), (G) und (B) mit ihren Farbwerten R, G und B gebildet. Die Farbwerte sind ohne physikalische Dimension.

Als Primärvalenzen, Normspektralfarben oder Primärfarben wurden monochromatische Strahlungen mit den Wellenlängen

![]()

festgelegt. Keine der Primärfarben darf aus den beiden anderen ermischbar sein.

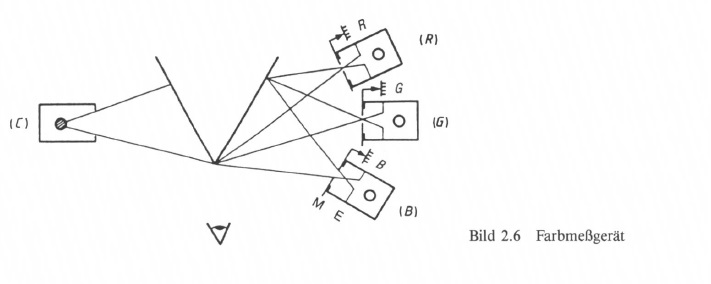

Die Anteile der Primärfarben, die in einem bestimmten Farbreiz enthalten sind, lassen sich mit Hilfe eines einfachen Instrumentes ermitteln (B i ld 2.6). Ein geknickter weißer Schirm wird von der einen Seite mit dem zu analysierenden Licht bestrahlt. Die andere Seite beleuchten drei in ihrer Intensität einstellbare Primärstrahler, die rotes (R), grünes (G) oder blaues (B) monochromatisches Licht abgeben. Die Intensität dieser Strahlungen kann durch Meßblenden M verändert werden, deren Öffnung an einer geeichten

Skala ablesbar ist. Das Farbmeßgerät ist abgeglichen, wenn die vordere Kante des Schirms nicht mehr erkennbar ist. In diesem Fall sind beide Schirmhälften mit Licht gleicher Helligkeit und Farbart beleuchtet. Die Eichung des Farbmeßgerätes erfolgt mit weißem Licht, dem sog. Gleichenergieweiß, als Referenzstrahlung. Bei voll geöffneten Meßblenden M werden dann die Eichblenden E solange verstellt, bis die Schirmkante unsichtbar wird. Die Farbgleichung ist dann erfüllt durch

![]()

Entsprechendes würde auch für alle Graustufen gelten, z. B. mit

![]()

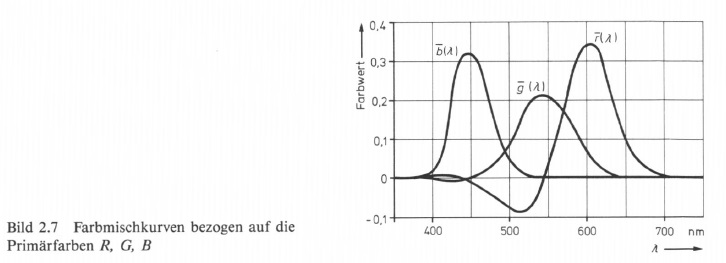

Auf der Grundlage der Farbgleichung Gl. (2.1) wurden nun Farbmischkurven ermittelt, denen für jede Spektralfarbe der erforderliche Anteil der Primärfarben zu entnehmen ist (Bild 2.7). Der Ordinatenmaßstab ist durch die Bezugnahme auf das Gleichenergieweiß bedingt. Für bestimmte Wellenlängenbereiche treten auch negative Farbwerte auf. Das bedeutet, daß zur Nachbildung bestimmter Spektralfarben zu dem betreffenden Farbreiz noch ein gewisser Anteil eines Primärreizes (z. B. Rot) hinzugefügt werden muß. Die Kurven nach Bild 2.7 finden in der Farbfernsehtechnik direkt keine Anwendung. Sie sind jedoch von grundsätzlicher Bedeutung und werden später durch andere Farbmischkurven ersetzt.

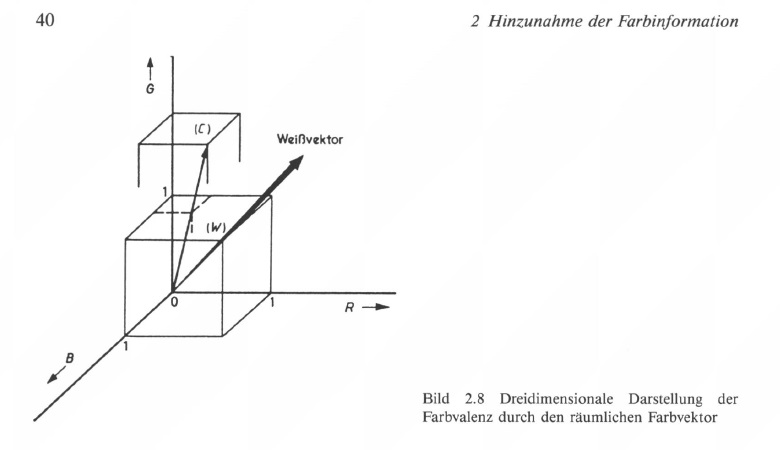

In einer dreidimensionalen Darstellung der Farbvalenzen im sog. Farbraum ergibt sich mit den drei Primärvalenzanteilen ein räumlicher Farbvektor (Bild 2.8). Die Richtung des Vektors im Raum bestimmt dabei die Farbart, die Länge des Vektors ist ein Maß für die Helligkeit. Der Ursprung des Koordinatensystems bedeutet Schwarz (R = G = B = 0), der Weißpunkt liegt bei R = G = B = 1. Diese Darstellung im dreidimensionalen Koordinatensystem ist zwar unbequem, sie führt aber bereits zu der Aufspaltung in die Empfindungsmerkmale Helligkeit und Farbart, mit Farbton und Farbsättigung.

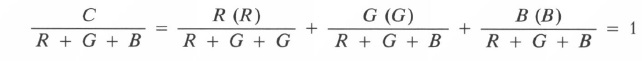

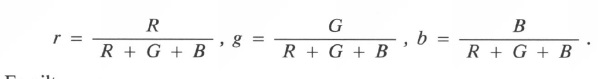

Es zeigt sich nämlich, daß die Helligkeit als Reizstärke unabhängig ist von der Farbart, die wiederum nur durch das Verhältnis der drei Primärvalenzanteile bestimmt wird. Damit kann man Helligkeit und Farbart voneinander trennen, indem man eine Normierung der Farbwerte auf die Helligkeit, entsprechend der Summe der Farbwerte, vornimmt.

Man erhält dann

beziehungsweise ausgedrückt durch die Farbwertanteile r, g und b, die sich aus den Farbwerten berechnen lassen zu:

Es gilt

![]()

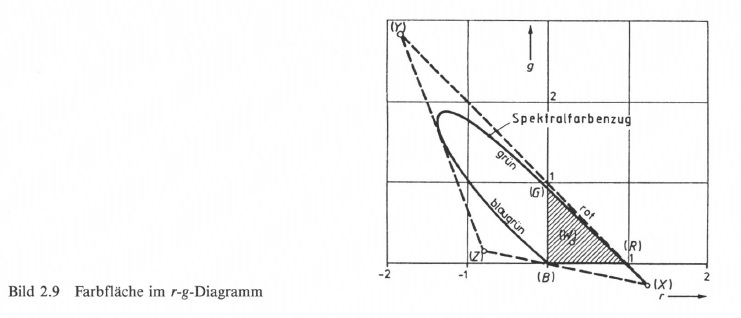

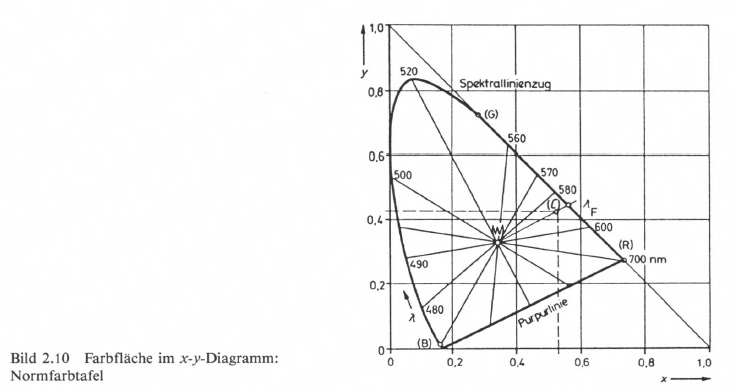

Die Farbwertanteile werden auch als reduzierte Farbwerte bezeichnet. In diesen reduzierten Farbwerten ist die Helligkeit bzw. Leuchtdichte nicht mehr enthalten, sondern nur noch die Farbart. Da aber die Summe von r und g und b immer gleich eins ist, kann man bei der Angabe der Farbart auf eine der drei Größen verzichten und kommt so zu einer zweidimensionalen Darstellung mit der Farbfläche. Trägt man in ein r-g-Koordinatensystem die über die Farbmischkurven ermittelten reduzierten Farbwerte ein, dann erhält man als Verbindung den sogenannten Spektralfarbenzug als geometrischen Ort aller Spektralfarben (Bild 2.9).

Bedingt durch den negativen Anteil der Rot-Farbmischkurve ergeben sich auch hier negative reduzierte Farbwerte. Durch eine Koordinatentransformation unter Bezugnahme auf neue, fiktive, das heißt aber physikalisch nicht realisierbare, Primärvalenzen X, Y und Z erhält man eine Darstellung, in der nur noch positive Farbwerte auftreten. Desweiteren liegt der Transformation zugrunde, daß die Helligkeit bzw. Leuchtdichte allein in der fiktiven Primärvalenz Y enthalten ist.

Auch mit diesen fiktiven Primärvalenzen und ihren Normfarbwerten X, Y und Z kann eine Normierung vorgenommen werden. Es gilt:

Wiederum ausgedrückt durch die Normfarbwertanteile x, y und z mit

erhält man

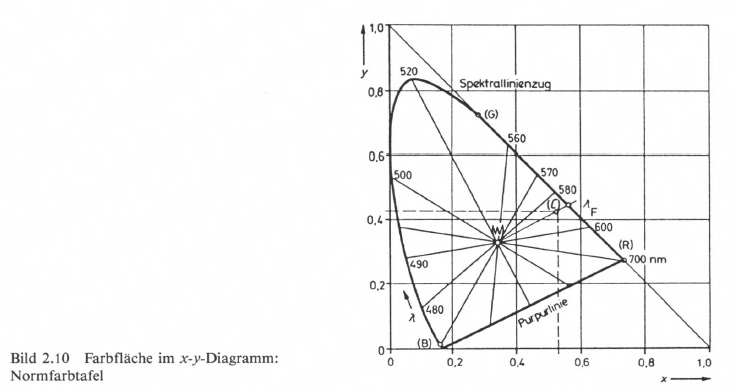

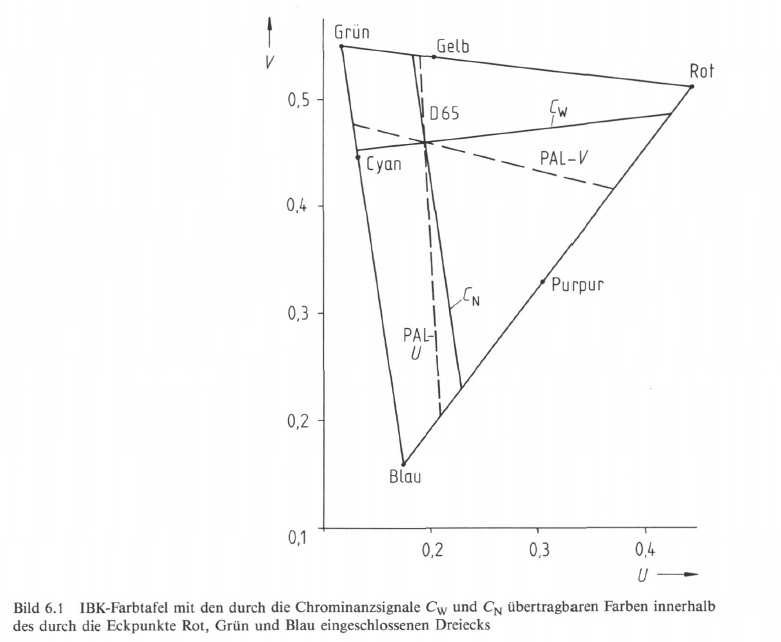

Die zweidimensionale Darstellung der Farbart im x-y-Koordinatensystem wird als Normfarbtafel nach IBK (Internationale Beleuchtungs-Kommission) oder CIE (Commission Internationale de l'Eclairage) bezeichnet. Bild 2.10 zeigt darin die durch den

Spektralfarbenzug und die Purpurlinie umschlossene Farbfläche und somit den durch additive Farbmischung aus den drei Primärvalenzen R, G und B realisierbaren Bereich möglicher Farbvalenzen. Der Weißpunkt W (Gleichenergieweiß) mit den Normfarbwertanteilenx = 0,33 und y 0,33 ergibt sich aus gleichen Anteilen von X, Y und Z genauso wie im R-G-B-System. Aus den beiden Normfarbwertanteilen x und y, die eine bestimmte Farbart kennzeichnen, lassen sich wiederum direkt keine Aussagen über den Farbton und die Farbsättigung machen.

Es kann jedoch der Farbton einer bestimmten Farbvalenz C durch die dominierende Wellenlänge IF bzw. im Falle der Purpurfarben, die als synthetische Farben im Spektrum des weißen Lichtes nicht enthalten sind und sich nur durch Mischung aus den Primärfarben Rot und Blau ergeben, durch die kompensative Wellenlänge IK der Komplementärfarbe gekennzeichnet werden. Man erhält die dominierende Wellenlänge, indem man den Ort der Farbart C mit den Normfarbwertanteilen xc und yc mit dem Weißpunkt W verbindet und diese Gerade bis zum Schnitt mit dem Spektrallinienzug verlängert. Dort kann die dominierende Wellenlänge abgelesen werden. Das Verhältnis des Streckenabschnittes CW vom Farbort bis zum Weißpunkt zu der Strecke SW vom Spektrallinienzug bis zum Weißpunkt gibt die Farbsättigung an. Je näher der Farbort C zum Weißpunkt rückt, umso geringer ist die Farbsättigung.

Der Farbort einer Mischfarbe liegt auf der Geraden zwischen den Farbvalenzen von zwei Ausgangsfarben bzw. bei drei Ausgangsfarben innerhalb des durch die Verbindungslinien eingeschlossenen Dreiecks. Komplementärfarben liegen sich, am Weißpunkt gespiegelt, gegenüber. In der Farbfernsehtechnik verwendet man die sogenannte Normfarbbalkenfolge als Farbbildvorlage. Darin sind neben Weiß und Schwarz die Grundfarben Rot, Grün und Blau enthalten sowie deren Komplementärfarben Cyan, Purpur und Gelb.

Bei der Festlegung von Bezugsgrößen in einem Farbfernsehsystem muß in erster Linie die Realisierbarkeit der Primärvalenzen auf der Empfängerseite berücksichtigt werden. Die Forderungen an die Empfänger-Primärstrahler sind vielfältig. Es soll durch sie einmal ein möglichst großer Bereich von Mischfarben darstellbar sein und auch voll gesättigte Farben sollen wiedergegeben werden, das heißt, die Farbkoordinaten der Empfänger-Primärstrahler sollten möglichst auf dem Spektralfarbenzug liegen. Andererseits braucht man Strahler, die eine hohe Leuchtdichte aufweisen und bei allen drei Farben mit möglichst gleichem Wirkungsgrad arbeiten. Dazu kommt noch die Forderung an eine wirtschaftliche Produzierbarkeit und Reproduzierbarkeit der Leuchtstoffe.

Mit der Einführung des Farbfernsehens in den USA wurden 1954 von der FCC (Federal Communications Commission) die Farbarten der Bildschirmphosphore genormt. Im Laufe der Zeit wurden jedoch Leuchtstoffe entwickelt, die bei gleichen Strahlströmen höhere Leuchtdichten ermöglichen. Um die Empfänger-Primärvalenzen den besseren Leuchtstoffen anzupassen, wurden von der EBU (European Broadcasting Union) für die europäischen Farbfernsehsysteme 1974 die Normfarbwertanteile dieser Primärstrahler neu festgelegt. Es gelten folgende Werte:

![]()

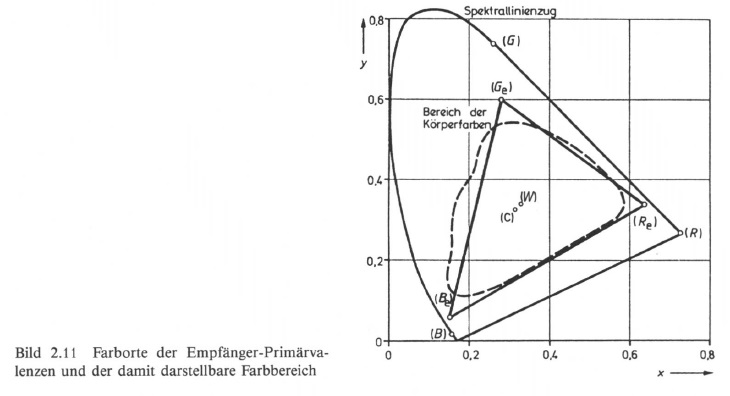

Die Farborte der Empfänger-Primärvalenzen Re, Ge und Be sind in der Normfarbtafel nach Bild 2.11 eingezeichnet. In diesem Bild ist auch ein Bereich der Körperfarben abgegrenzt, innerhalb dem nahezu alle praktisch vorkommenden Farben liegen [36]. Man erkennt daraus, daß der durch das Dreieck Re-Ge-Be erfaßte Bereich eine hinreichend naturgetreue Wiedergabe von Farbbildszenen erlaubt.

Bei der Ermittlung der Farbmischkurven nach Bild 2.7 über die Anteile R, G und B der Primärreize wurde das Gleichenergieweiß W als Bezugsgröße zugrunde gelegt. Das bedeutet, dass gleiche Anteile R, G und B in additiver Mischung den Farbreiz W mit der Sättigung Null ergeben. Im x-y-Koordinatensystem der Normfarbtafel ist der Weißpunkt W durch die Normfarbwertanteilex = 0,33 und y = 0,33 definiert. In der Farbfernsehtechnik wird die Normlichtart C als Bezugsweiß verwendet. Dieses Weiß entspricht dem mittleren Tageslicht mit einer Farbtemperatur von etwa 6700 K. Die Normlichtart C lässt sich durch eine Wolfram-Glühlampe (Normlichtart A und ein vorgesetztes Filter) erzeugen. Die Farbkoordinaten sind:

Ein weiteres tageslichtähnliches Weiß stellt die Normlichtart D 65 dar mit den Normfarbwertanteilen

Letzte Festlegungen der EBU hinsichtlich „Weiß" in Verbindung mit den Empfänger-Primärstrahlern beziehen sich auf die Normlichtart D 65. Diese läßt sich aber, im Gegensatz zur Normlichtart C, durch eine künstliche Lichtquelle nicht exakt realisieren. Eine Annäherung erreicht man mit einer Xenonlampe und bestimmten Farbfiltern [36].

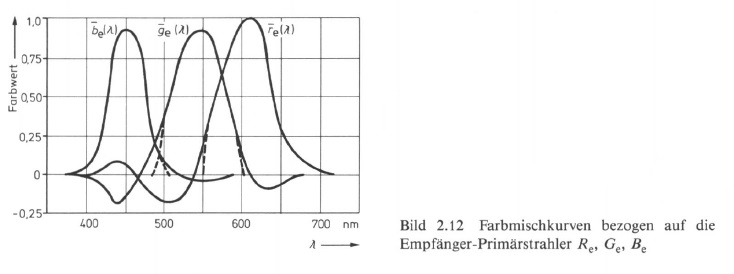

Werden nun für alle spektralen Farbreize mit gleicher Strahlungsenergie die Farbwertanteile der Empfänger-Primärstrahler ermittelt und über der Wellenlänge als normierte Farbwerte aufgetragen (der Maximalwert der Kurve ist auf 1,0 bezogen), dann erhält man die in der Fernsehtechnik maßgeblichen Farbmischkurven (Bild 2.12). Es treten auch hier wieder negative Werte auf, bedingt durch die Farbvalenzen außerhalb des durch Re, Ge und Be gebildeten Dreiecks in Bild 2.11.

Die Farbmischkurven werden deshalb für den praktischen Betrieb geringfügig geändert (gestrichelt eingezeichnet). Auf diese Farbmischkurven müssen die Signale im Rot-, Grün- und Blau-Kanal der Farbkamera über die spektrale Empfindlichkeit der Aufnahme-Bildwandler und durch zusätzliche Farbfilter abgestimmt werden. Die Ausgangsspannungen der Farbkamera in den drei Kanälen müssen bei den verschiedenen Spektralfarben das gleiche Verhältnis zueinander haben wie die Werte der Farbmischkurven. Beim Bezugsweiß müssen die Ausgangsspannungen untereinander gleich sein und das auch bei verschiedenen Werten der Leuchtdichte. Diese Forderung wird über das zeilenfrequente Oszillogramm der Ausgangsspannungen in den drei Kanälen an Hand eines horizontalen Graukeils oder einer Grautreppe als Bildvorlage geprüft.

Beim Abschnitt 2.2 verwendete Literatur: [3, 4, 7, 36, 37, 38, 39].

2.3 Leuchtdichte- und Farbartsignal

Aus Gründen der Kompatibilität wird gefordert, dass bei einer bunten Bildvorlage aus den Farbwertsignalen einer Farbfernsehkamera das gleiche Signal abgeleitet werden kann, wie dies eine Schwarzweißkamera liefert, nämlich das Helligkeits- oder Leuchtdichtesignal. Damit wird auf dem Schirm einer Schwarzweiß-Bildröhre ein Helligkeitsbild hervorgerufen, das keinen Unterschied in Bezug auf die Quelle des elektrischen Signals erkennen lässt.

2.3.1 Leuchtdichtesign

Die spektrale Empfindlichkeit eines Schwarzweiß-Bildaufnehmers wird der Augenempfindlichkeitskurve angepaßt, damit eine Schwarzweiß-Bildröhre die verschiedenen Farbreize als Graustufen mit der Helligkeit wiedergibt, mit der sie vom Auge auch in der Bildvorlage empfunden werden. Die Farbfernsehkamera aber liefert zunächst drei Signale, in dem Rot-, dem Grün- und dem Blau-Kanal, mit der spektralen Abhängigkeit gemäß dem Verlauf der Farbmischkurven (siehe Bild 2.12). Um aus diesen drei Signalen eines zu gewinnen, das in seiner spektralen Abhängigkeit wieder dem Verlauf der Augenempfindlichkeitskurve entspricht, muß man eine entsprechende Codierung vornehmen. Über die Funktionswerte h(Re), h(Ge) und h(Be), die bei den Empfänger-Pirmärvalenzen aus der Augenempfindlichkeitskurve entnommen werden (Bild 2.13), mit

![]()

erfolgt eine Bewertung der Signale aus den drei Farbkanälen. Die Farbwertsignale, dargestellt durch ihre spektralen Funktionen Fe(X) und ge(X) und be(X), werden dazu mit den relativen Helligkeitswerten hr , h und hb multipliziert. Diese gewinnt man durch Normierung aus den Helligkeitsbeiwerten h(Re), h(Ge) und h(Be). Das Ergebnis muß dann, bis auf eine Proportionalitätskonstante k, identisch sein mit der Augenempfindlichkeitskurve h(1);

Zur Berechnung der relativen Helligkeitsbeiwerte bildet man zunächst die Summe der Funktionswerte h(. .) mit

![]()

und normiert dann die einzelnen Funktionswerte auf diesen Divisor. Die relativen Helligkeitsbeiwerte ergeben sich dann zu

![]()

Wegen der Normierung gilt

Für Gl. (2.10) folgt dann

In der Farbfernsehtechnik ist es üblich, die Leuchtdichte mit Y zu bezeichnen. Dies basiert, wie schon erwähnt, auf der Festlegung, die bei der Transformation der Primärvalenzen R, G, B in die fiktiven Primärvalenzen X, Y, Z getroffen wurde, dass nämlich der Helligkeitsanteil eines Farbreizes allein durch den Wert der Primärvalenz Y bestimmt wird. Damit ist auch der Verlauf der Normspektralwertkurve j (1) identisch mit der Hellempfindlichkeitskurve h

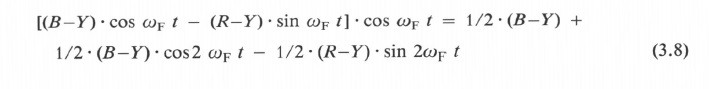

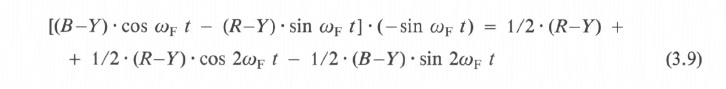

In vereinfachter Schreibweise erhält man dann die Codiervorschrift für die Leuchtdichteinformation Y aus den Farbwertanteilen R, G und B zu

![]()

Die Gl. (2.15) stellt eine der wichtigsten Beziehungen der Farbfernsehtechnik dar. Sie bildet die Grundlage für die Erzeugung des Leuchtdichtesignales aus den Farbwertsignalen des Bildaufnahmesystems. Technisch wird das Leuchtdichtesignal UY über eine Matrixschaltung aus den Farbwertsignalen UR, UG und UB gewonnen (Bild 2.14) nach der Beziehung

Der Begriff „Leuchtdichte" wird auch in der deutschen Literatur vielfach durch den aus dem englischen Wort luminance abgeleiteten Ausdruck „Luminanz" ersetzt, so dass aus dem „Leuchtdichtesignal" gleichbedeutend das „Luminanzsignal" wird.

Genaugenommen müssen der Matrixschaltung die gammakorrigierten Farbwertsignale zugeführt werden, um bei der Farbbildwiedergabe die Nichtlinearität in der Übertragungsfunktion der Farbbildröhrensysteme auszugleichen. Im Folgenden wird jedoch der Einfachheit halber von den unkorrigierten Farbwertsignalen ausgegangen.

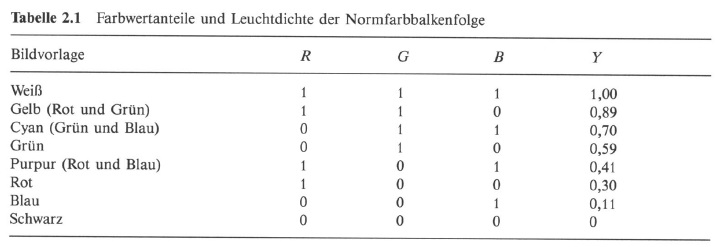

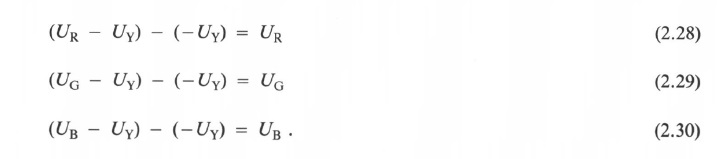

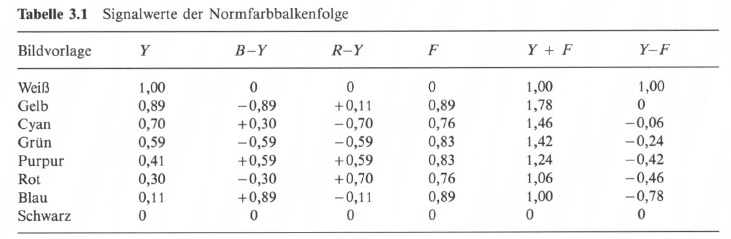

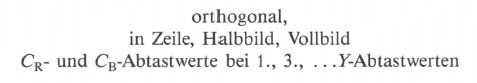

Für die in der Farbfernsehtechnik als Testvorlage dienende Normfarbba/kenfolge, bestehend aus den Primärfarben und den dazugehörigen Komplementärfarben als Mischfarben sowie den Unbuntstufen Weiß und Schwarz, erhält man die Leuchtdichte Y aus den Farbwertanteilen R, G und B über die Gl. (2.15), wie sie in Tabelle 2.1 zusammengestellt sind.

Aus der Tabelle 2.1 ist ersichtlich, dass die Reihenfolge der Normfarbbalken nach sinkendem Leuchtdichtewert geordnet ist.

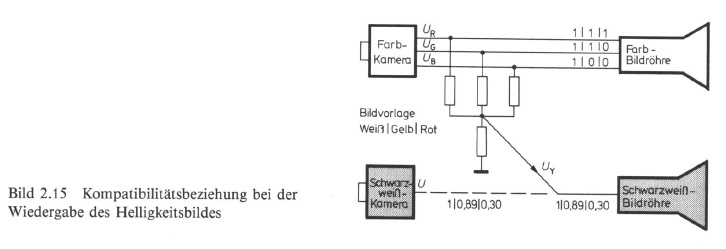

Die Kompatibilitätsbeziehung zeigt Bild 2.15 an einer einfachen Bildvorlage Weiß Grün-Rot. In ähnlicher Weise könnte auch die Rekompatibilität demonstriert werden, indem das Bildsignal der Schwarzweiß-Kamera parallel den drei Steuereingängen der Farbbildröhre zugeführt wird. Bei gleichen Signalwerten am R-, G- und B-Eingang wird ein unbuntes Bild wiedergegeben.

2.3.2 Farbdifferenzsignale zur Angabe der Farbart

m System der kompatiblen Farbbildübertragung sind im weiteren noch Signale erforderlich, die zur Leuchtdichte keinen Beitrag leisten und nur eine Information über die Farbart enthalten. Nachdem Farbton und Farbsättigung technisch nicht getrennt durch unabhängige Signale darstellbar sind, beschreitet man einen Umweg über die Farbdifferenzsignale. Diese ergeben sich aus den um den Leuchtdichteanteil reduzierten Farbwerten zu R-Y, G-Y und B-Y.

Zur Bildung eines Farbartsignales als Doppelinformation genügen zwei von den drei Farbdifferenzsignalen. Üblicherweise werden die Signale

verwendet.

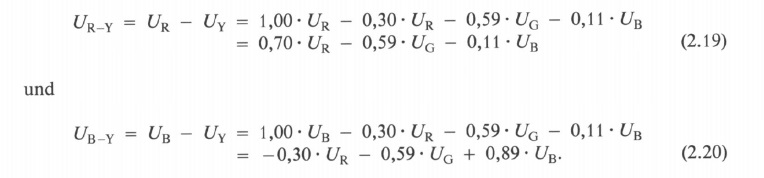

Über das Leuchtdichtesignal nach Gl. (2.16) erhält man die Zusammensetzung der beiden Farbdifferenzsignale zu

Technisch werden die Farbdifferenzsignale meist in Verbindung mit dem Leuchtdichtesignal in einer Matrixschaltung erzeugt.

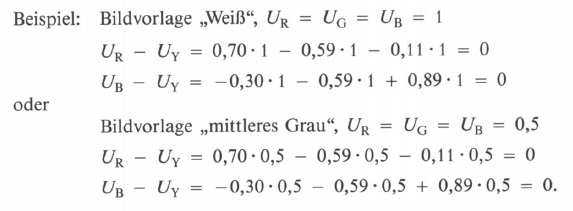

Die Farbdifferenzsignale enthalten nur eine Information über die Farbart. Bei unbunten Bildvorlagen, also wenn UR = UG = UB ist, werden sie zu null.

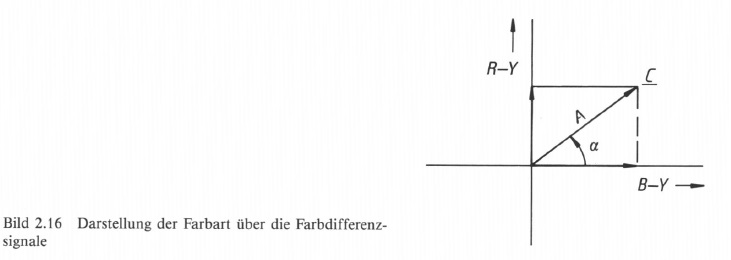

Die Darstellung des Farbortes, hier durch die Farbart, einer Farbvalenz kann nun auch durch die Farbdifferenzwerte B—Y und R—Y in einem rechtwinkligen Koordinatensystem erfolgen, wie in Bild 2.16 gezeigt. Durch Transformation in Polarkoordinaten erhält man aus dem Betrag A des Vektors C mit

ein Maß für die Farbsättigung und aus dem Winkel

eine Aussage über den Farbton.

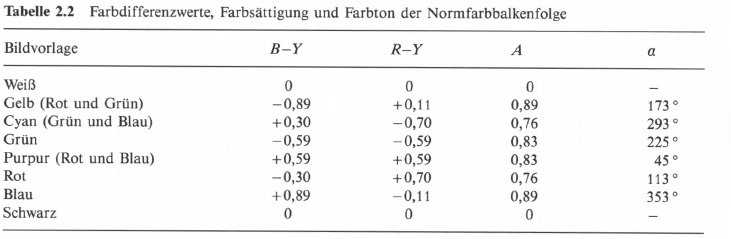

Für die Normfarbbalkenfolge ergibt dies die in Tabelle 2.2 zusammengestellten Werte.

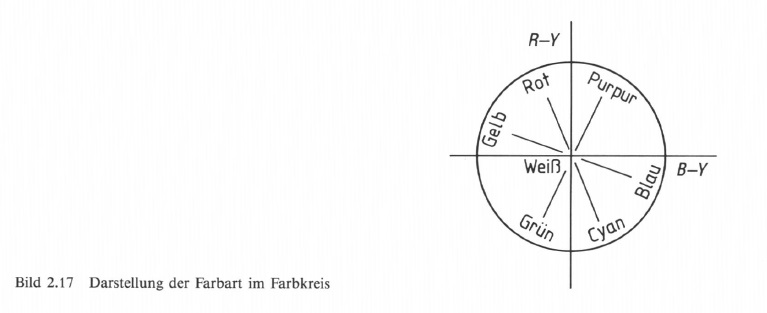

Wie daraus zu entnehmen ist, gehen die Farbdifferenzwerte auch ins Negative. Die Vektorendpunkte für die Normfarbbalkenfolge verteilen sich auf die vier Quadranten des Koordinatensystems. Auch in dieser Darstellung liegen sich Primärfarben und zugehörige Komplementärfarben am Weiß- bzw. Unbuntpunkt (Koordinatennullpunkt) gespiegelt gegenüber. In einer etwas modifizierten Darstellung nach Bild 2.17 erkennt man, dass die Grund- und Mischfarben auf einem Kreis um den Unbuntpunkt liegen. Man spricht deshalb auch von dem sog. Farbkreis.

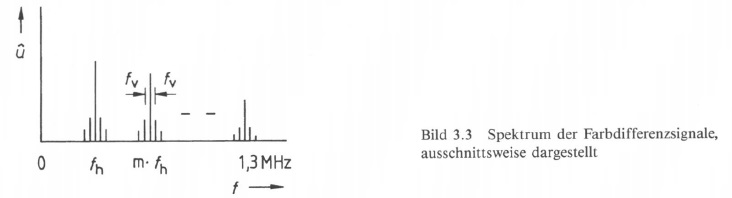

Untersuchungen haben ergeben, dass das menschliche Auge für farbige Bilddetails ein geringeres Auflösungsvermögen hat als für Helligkeitsänderungen. Es genügt daher, nur das Leuchtdichtesignal mit der vollen Bandbreite von z. B. 5 MHz zu übertragen. Die Farbartinformation kann ohne Beeinträchtigung der Farbbildqualität auf etwa 1 MHz bandbegrenzt werden. Die dadurch entstehende Signalverzögerung gegenüber dem breitbandigen Leuchtdichtesignal muß allerdings ausgeglichen werden. Siehe Abschnitt 3.

2.3.3 Rückgewinnung der Farbwertsignale

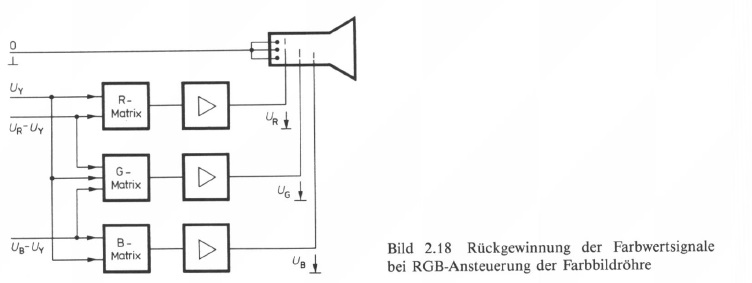

Die auf der Sendeseite erzeugten Signale UR, UG und UB werden in der Matrixschaltung in das Leuchtdichtesignal UY und die Farbdifferenzsignale UR — UY und UB— UY umgewandelt. Lässt man die weitere Signalverarbeitung zunächst einmal außer Betracht, dann stehen diese Signale auch auf der Empfangsseite zur Verfügung. Die Wiedergabe des Farbbildes erfolgt aber in jedem Fall über die drei Farbauszugsbilder in den Grundfarben Rot, Grün und Blau. Zur Steuerung der Farbbildröhre oder einer ähnlichen Einrichtung sind daher wieder die Farbwertsignale UR, UG und UB notwendig. Zwei Verfahren der Farbbildröhrenansteuerung sind möglich: Erzeugung der Farbwertsignale und RGB-Ansteuerung der Farbbildröhre (Bild 2.18).

Über Matrixschaltungen werden aus dem Leuchtdichtesignal UY und den Farbdifferenzsignalen UR — UY und UB — UY die Farbwertsignale nachfolgenden einfachen Beziehungen gebildet:

Das nicht übertragene (G—Y)-Signal wird gemäß der noch folgenden Beziehung Gl. (2.27) aus dem (R—Y)- und dem (B—Y)-Signal gewonnen. Die Farbwertsignale UR, UG und UB gelangen direkt zu den entsprechenden Steuergittern der Farbbildröhre, die Katoden liegen auf festem Potential.

Dieses Verfahren erfordert Videoverstärkerstufen im R-, G- und B-Kanal mit der vollen Bandbreite von 5 MHz und hoher Linearität. Eine gegenseitige Abweichung des Verstärkungsfaktors führt zu Farbverfälschungen. Gegenkopplungsmaßnahmen sind deshalb in diesen Verstärkerstufen unumgänglich.

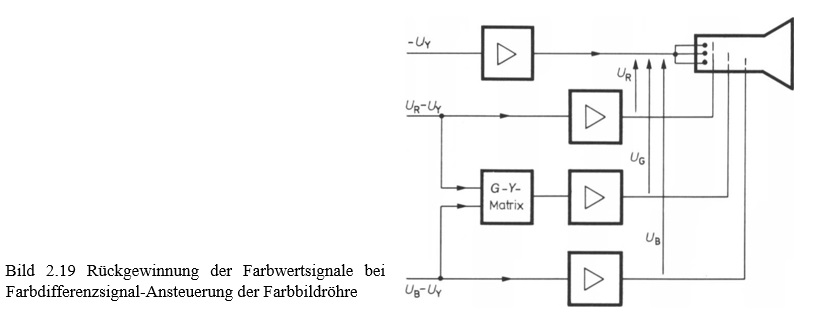

Erzeugung des Grün-Farbdifferenzsignales und Steuerung der Farbbildröhre durch die Farbdifferenzsignale (Bild 2.19).

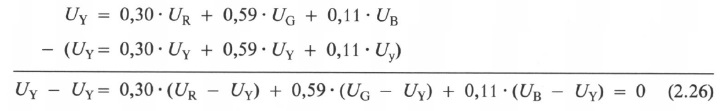

Aus den beiden Farbdifferenzsignalen UR — UY und UB — UY wird in einer Matrixschaltung das dritte Farbdifferenzsignal UG — UY gewonnen. Zu Grunde liegt der Ansatz:

beziehungsweise nach Umformung

![]()

Die Farbdifferenzsignale liegen an den Steuergittern der Strahlsysteme, das negative Leuchtdichtesignal an den Katoden, so dass sich als Steuerspannungen an den drei Systemen der Farbbildröhre ergeben

Als Vorteil dieses Verfahrens kann die geringere Bandbreite der Endverstärkerstufen für die Farbdifferenzsignale angeführt werden mit nur 1 , 3 MHz. Allerdings müssen diese für einen größeren Spannungshub ausgelegt werden. Die Steuerspannungen bei der Farbdifferenzsignal-Ansteuerung erreichen teilweise fast das Zweifache der entsprechenden Farbwertsignalspannungen. Aus der Darstellung der verschiedenen Signale für eine Normfarbbalken-Farbbildvorlage gemäß Bild 2.20 geht dies hervor. Für die Spannungen an der Bildröhre wäre etwa der Maßstabsfaktor 100 zutreffend.

Nach Stand der Technik 1995 wird in den Farbfernsehempfängern durchwegs die RGB-Ansteuerung der Farbbildröhre angewendet, damit eine definierte RGB-Schnittstelle vorhanden ist, um Videotext-Signale oder externe RGB-Farbsignale ohne weitere Anpassungsschaltungen wiedergeben zu können.

3. Farbbildsignalübertragung im Frequenzmultiplex

Wie im vorangehenden Abschnitt ausführlich erläutert, geschieht die Aufbereitung des Farbfernsehsignales aus Gründen der Kompatibilität in das Leuchtdichtesignal und in die beiden Farbdifferenzsignale. Zur Übertragung der vollständigen Bildinformation — Leuchtdichte und Farbart — ist damit ein dreifach belegbarer Übertragungskanal notwendig. Zu denken wäre an eine Mehrfachausnutzung des Fernsehübertragungskanales nach dem Frequenzmultiplexverfahren oder nach dem Zeitmultiplexverfahren. Beide Möglichkeiten erweisen sich aber, beim Frequenzmultiplexverfahren zumindest im ersten Augenblick, als nicht kompatibel mit dem bereits eingeführten Schwarzweiß-Übertragungsverfahren. Ein Nebeneinander von Leuchtdichte- und Farbartinformation auf der Frequenzachse durch Umsetzung der Farbdifferenzsignale scheidet bei dem auf eine Bandbreite von 5 MHz begrenzten Übertragungskanal von vornherein aus.

Ein für das tatsächlich gewählte Farbübertragungsverfahren entscheidender Gedanke leitet sich von der spektralen Analyse des Leuchtdichte- bzw. BAS-Signales ab. Es zeigt sich nämlich, dass das BAS-Signal kein kontinuierliches Frequenzspektrum besitzt, sondern ein Linienspektrum, in dem nur bestimmte Frequenzkomponenten auftreten. Diese werden im Wesentlichen, wegen des periodischen Abtastvorganges, durch Vielfache der Zeilenfrequenz gebildet.

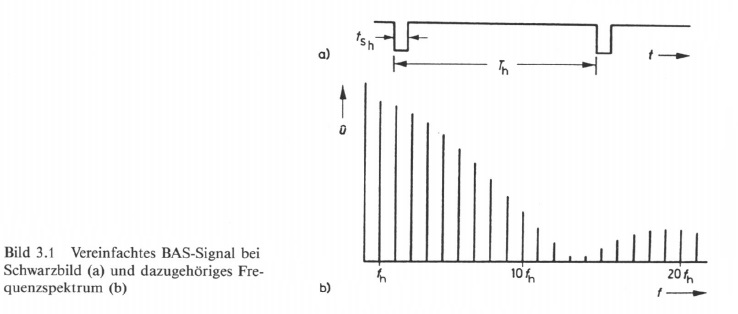

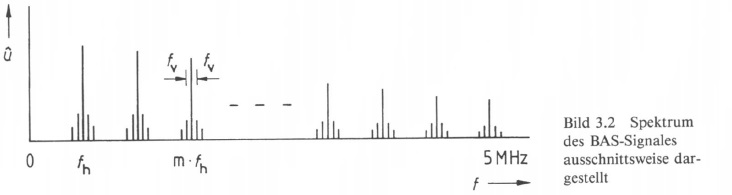

Betrachtet man zunächst einen sehr vereinfachten Fall, z.B. das BAS-Signal bei Schwarzbild mit durchlaufender periodischer Wiederholung nur eines HorizontalSynchronimpulses, dann lässt sich dafür über eine Fourier-Analyse das dazugehörige Frequenzspektrum ermitteln. Es zeigt sich, daß Spektralkomponenten nur bei Vielfachen der Horizontalfrequenz fh auftreten (Bild 3.1). Bei der Bildvorlage Weiß oder einer Graustufe erhält man bereits die Überlagerung von zwei Spektren mit Komponenten gleicher Frequenzen, aber unterschiedlicher Amplitudenverteilung. Der allgemeine Fall einer beliebigen unbewegten Bildvorlage lässt sich hinsichtlich der Helligkeitsverteilung zurückführen auf Grundkomponenten eines horizontalen und vertikalen Streifenmusters. Dies führt zu Spektralkomponenten bei gebrochenen oder ganzzahligen Vielfachen der Zeilenfrequenz. Durch Hinzunahme der Vertikal-Synchronimpulse mit der Folgefrequenz fv erhält man das Spektrum des BAS-Signales in der Zusammensetzung aus Harmonischen der Horizontalfrequenz (m • fh) und deren Seitenschwingungen im

Abstand von Vielfachen der Bildwechselfrequenz (n • fw). Vereinfacht wird dabei zunächst von progressiver Bildabtastung ausgegangen. Bei Zeilensprungabtastung treten die Seitenschwingungen zu den Vielfachen der Horizontalfrequenz im Abstand von Vielfachen der Vertikalfrequenz (m • fv) auf.

Einen Ausschnitt dieses Spektrums zeigt Bild 3.2. Das Zeilensprungverfahren hat darüber hinaus noch eine Verschachtelung der Seitenbänder von aufeinanderfolgenden zeilenfrequenten Spektralkomponenten zur Folge, was aber praktisch durch die rasch mit der Ordnungszahl n abklingende Amplitude dieser Seitenschwingungen nicht zutage tritt. Ein schwankender Bildinhalt bei bewegten Bildvorlagen führt zu einer Amplitudenmodulation der Impulsfolge des ruhenden Bildes und äußert sich im Wesentlichen wieder in den Seitenspektren zu den Harmonischen der Horizontalfrequenz [3, 6, 7].

Man erkennt also, dass das Frequenzband des BAS-Signales tatsächlich im Wesentlichen nur bei Vielfachen der Horizontalfrequenz und in deren naher Umgebung belegt ist. Dazwischen weist das Spektrum bedeutende Lücken auf. Da auch die Farbartinformation zeilenperiodisch auftritt, wird das Spektrum der Farbdifferenzsignale B—Y und R—Y sich ebenfalls auf Vielfache der Horizontalfrequenz mit ihren Seitenbändern konzentrieren (Bild 3.3).

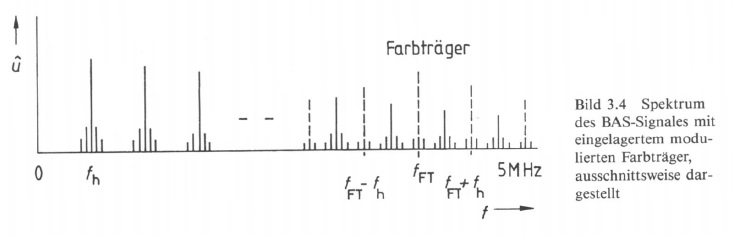

Es liegt deshalb nahe, die zusätzliche Farbinformation in die Lücken des Frequenzspektrums des BAS-Signales einzufügen. Dies geschieht, indem die Farbartinformation einer

sinusförmigen Trägerschwingung auf moduliert wird, deren Frequenz fFT und damit auch das Spektrum der zeilenfrequenten Modulationsprodukte, zwischen den Spektralkomponenten des BAS-Signales liegt (Bild 3.4). Man könnte so diesen besonderen Fall des Frequenzmultiplex-Prinzips auch als „Frequenzlücken-Multiplex" bezeichnen.

3.1 Übertragung der Farbart mittels Farbträger

3.1.1 Festlegung der Farbträgerfrequenz

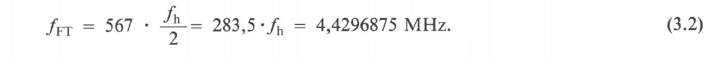

Eine erste Bedingung für die Frequenz des Farbträgers leitet sich aus der symmetrischen Verschachtelung von BAS-Signal- und Farbartsignalspektrum ab: Die Farbträgerfrequenz fFT muss dazu ein ungeradzahliges Vielfaches der halben Zeilenfrequenz fh sein:

Man erhält so den sogenannten Halbzeilen-Offset.

Die gemeinsame Übertragung des modulierten Farbträgers mit dem BAS-Signal wirft allerdings gewisse Probleme auf, wenn der Farbträger im Leuchtdichtekanal des Bildwiedergabesystems nicht genügend unterdrückt werden kann. Eine Helligkeitsschwankung längs der Zeilen des Fernsehbildes kann sich bemerkbar machen.

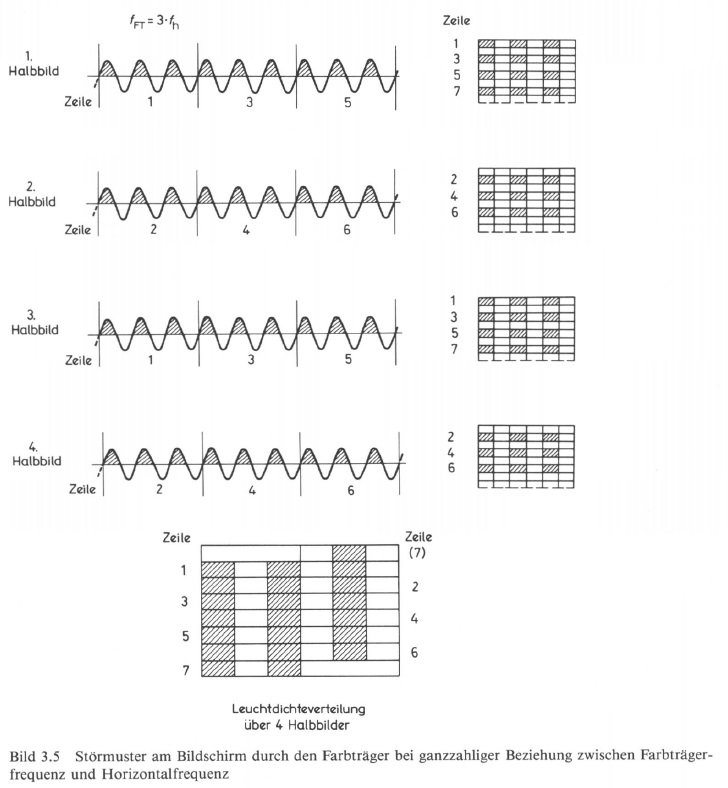

Der Störeinfluß des Farbträgers auf das Helligkeitsbild lässt sich erklären, wenn vereinfacht davon ausgegangen wird, dass eine dem BAS-Signal überlagerte sinusförmige Schwingung ein Hell-Dunkel-Störmuster am Bildschirm hervorruft. Bei einer ganzzahligen Beziehung zwischen Farbträgerfrequenz und Horizontalfrequenz mit fFT = n • fh tritt dann ein Störmuster aus hellen und dunklen vertikalen Streifen auf, deren Anzahl über die Zeilendauer entsprechend dem Faktor n ist (Bild 3.5). Die Horizontal-Austastlücke ist bei dieser schematisierten Betrachtung nicht berücksichtigt.

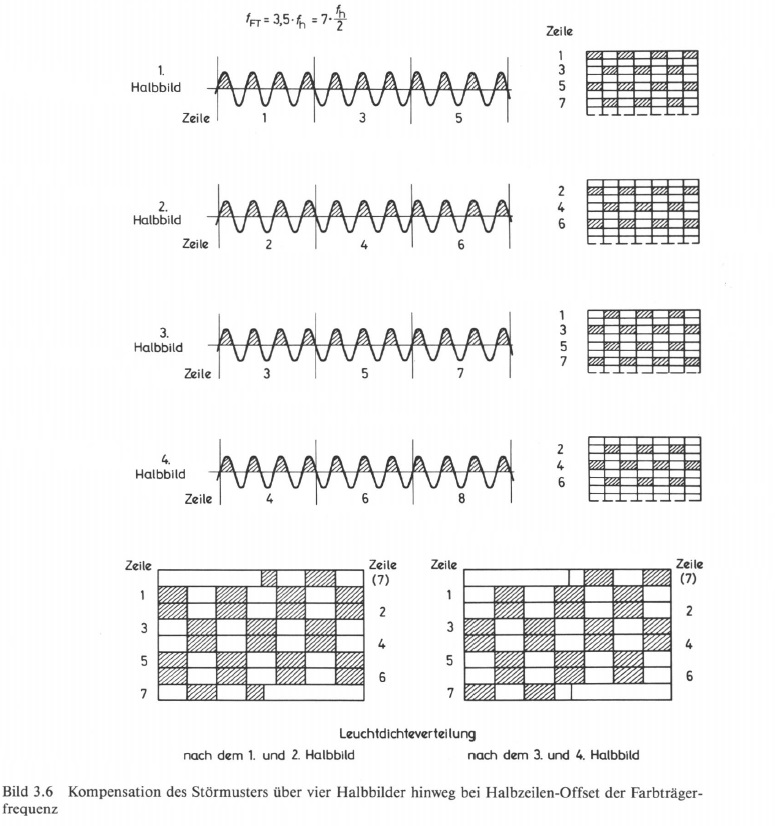

Durch den Halbzeilen-Offset ergibt sich ein Wechsel der Phasenlage der Farbträgerschwingung von 180 0 von Zeile zu Zeile in einem Halbbild. Nach jeweils zwei gleichen Rasterbildern (1. und 3. Halbbild, 2. und 4. Halbbild) aber fallen, wegen der ungeraden Zeilenzahl, helle und dunkle Bildpunkte aufeinander. Das im Takt von 4 • TV, entsprechend einer Frequenz von fv/4 = 12,5 Hz periodisch schwankende Störmuster würde sich so über vier Halbbilder hinweg kompensieren (Bild 3.6). Die Kompensation des Störmusters ist jedoch wegen der Nichtlinearität der Bildröhrenkennlinie und des nicht ausreichenden Integrationsvermögens des Auges bei dieser niedrigen Schwankungsfrequenz nur unvollkommen.

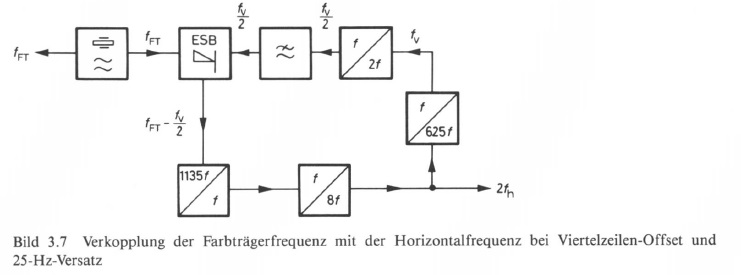

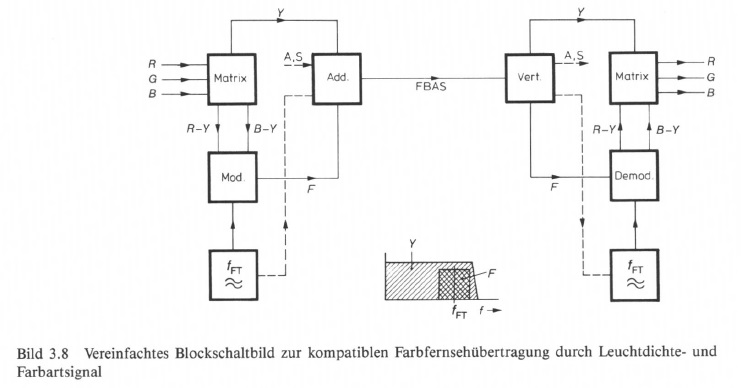

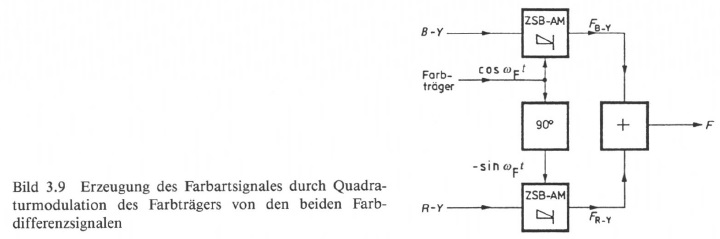

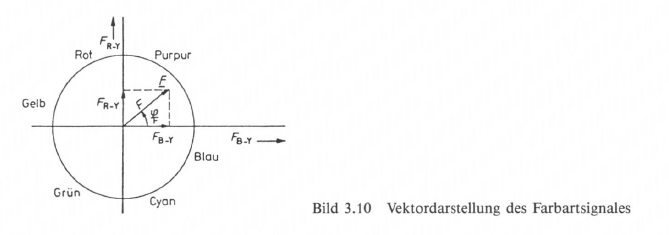

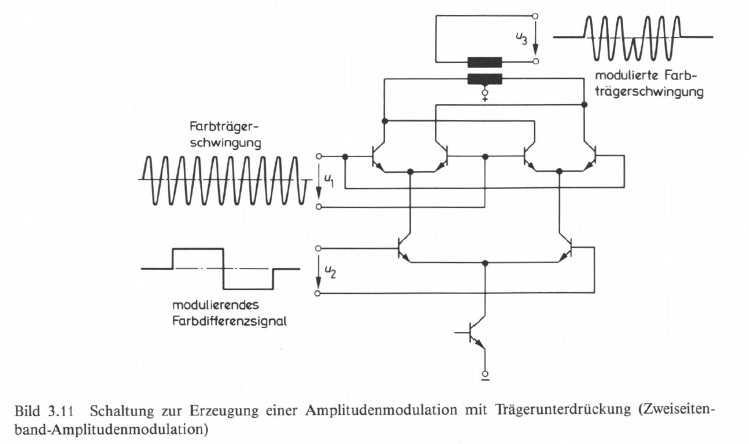

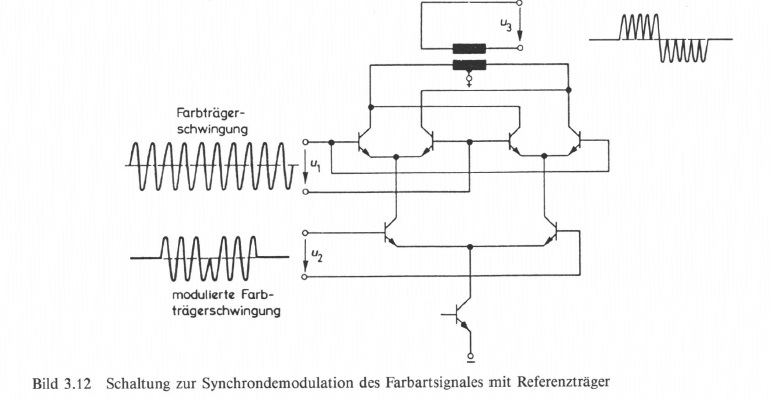

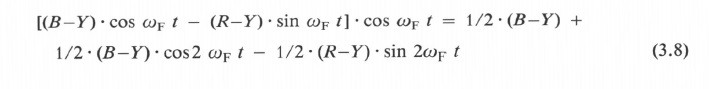

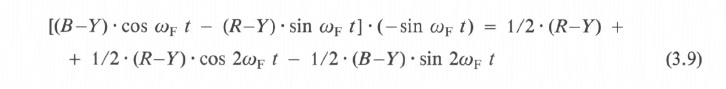

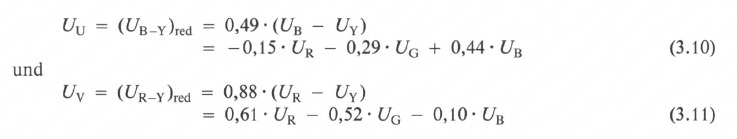

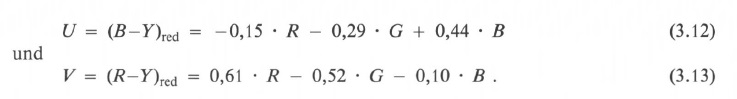

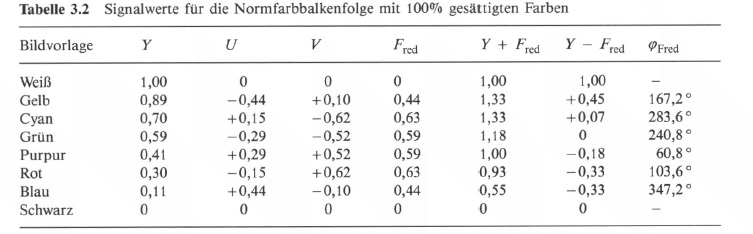

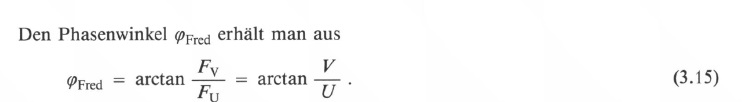

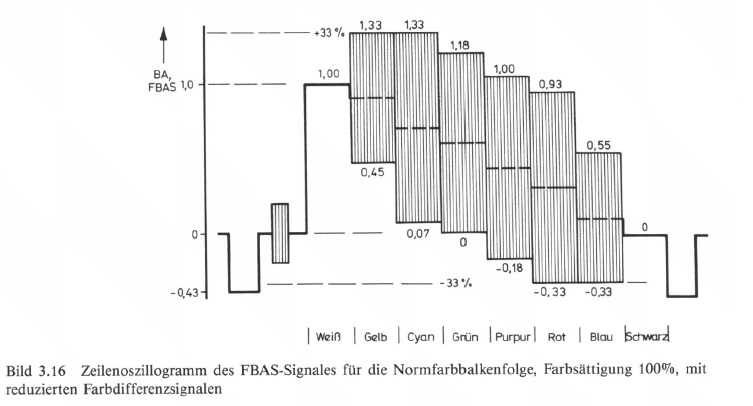

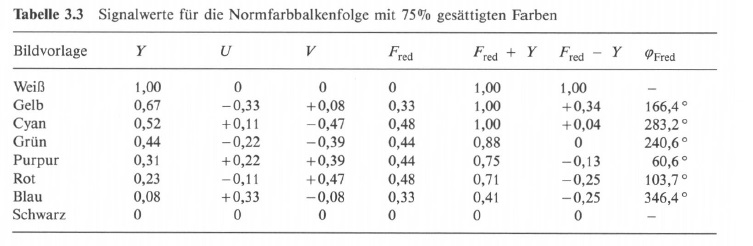

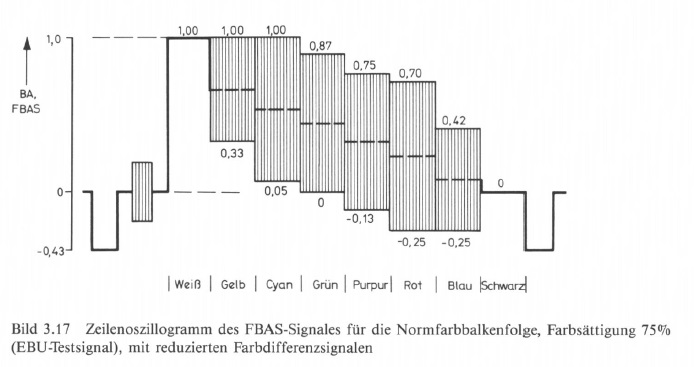

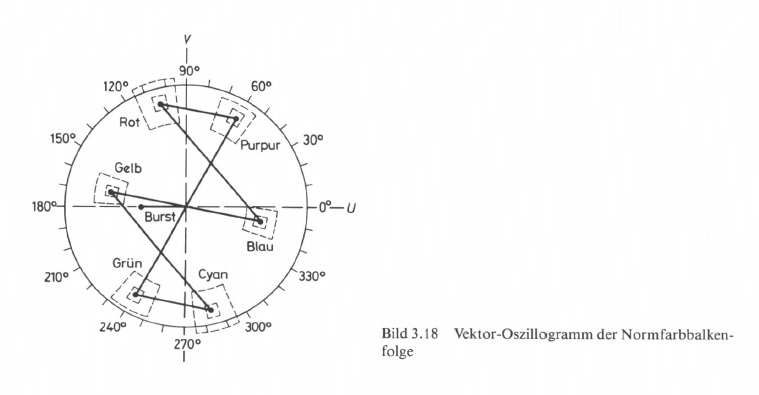

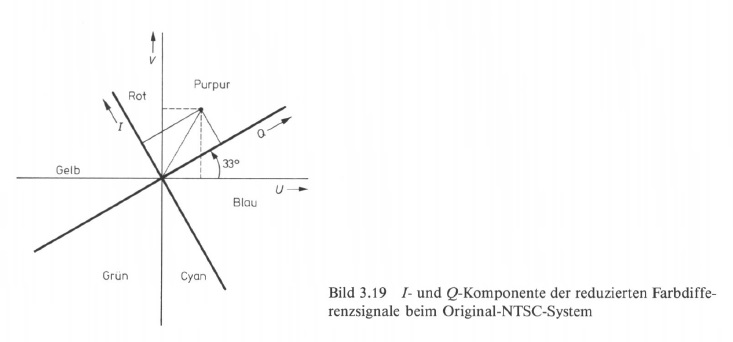

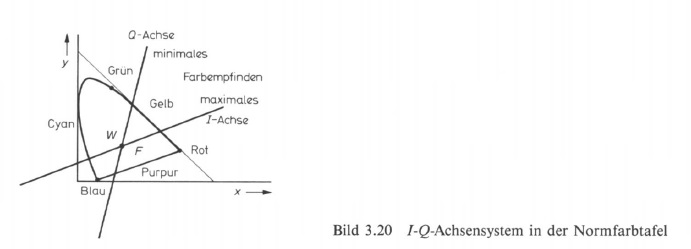

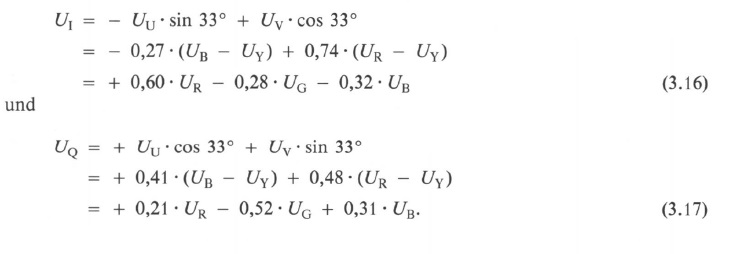

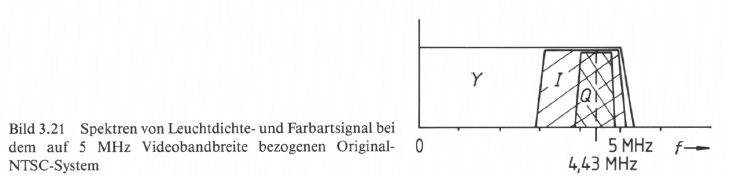

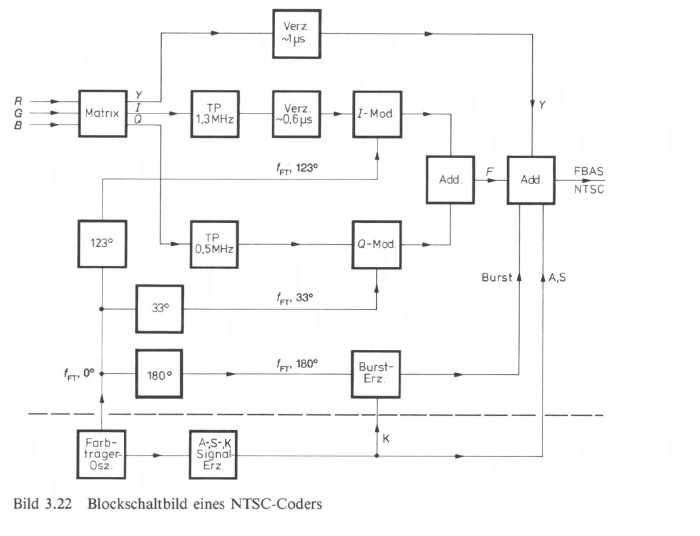

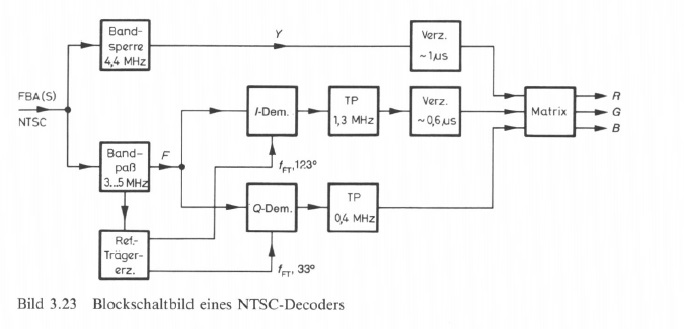

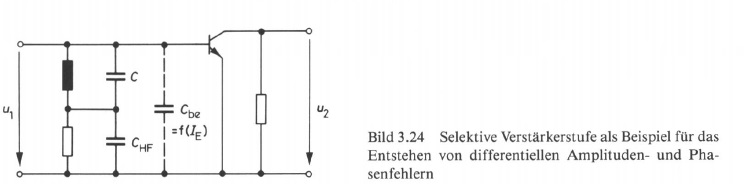

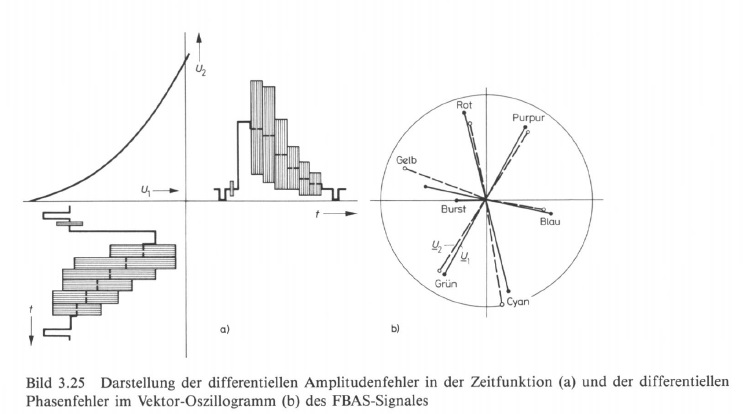

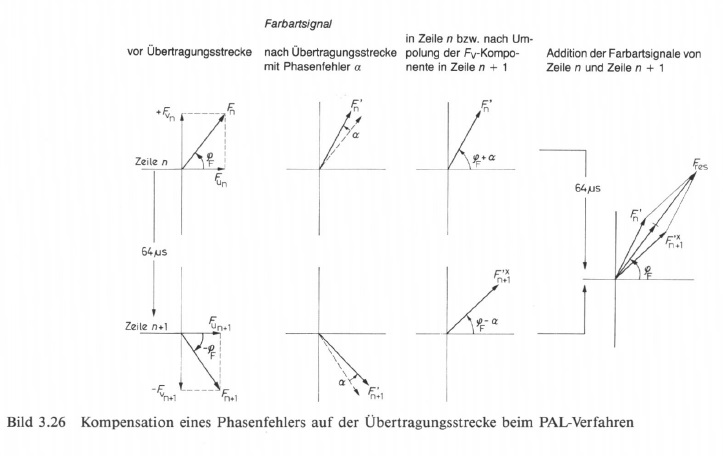

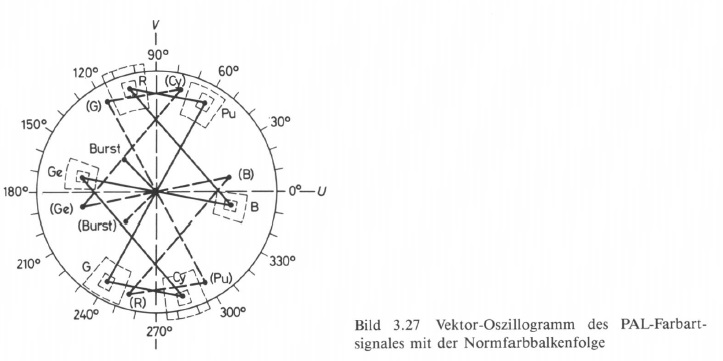

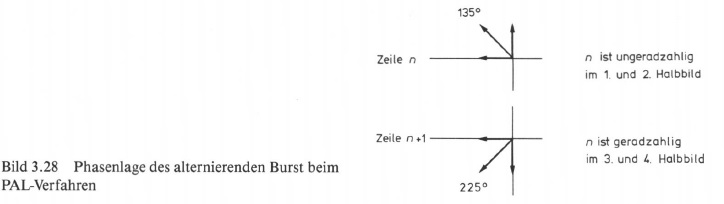

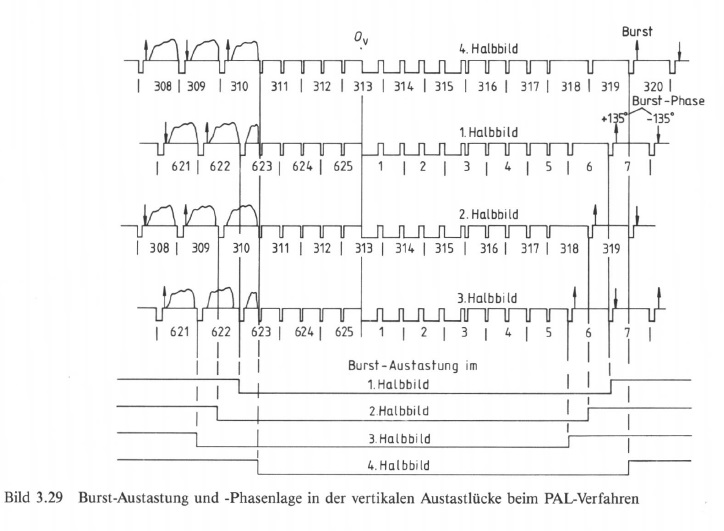

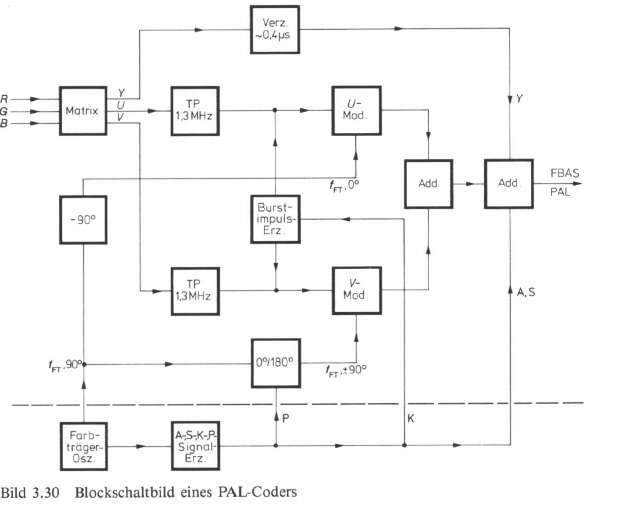

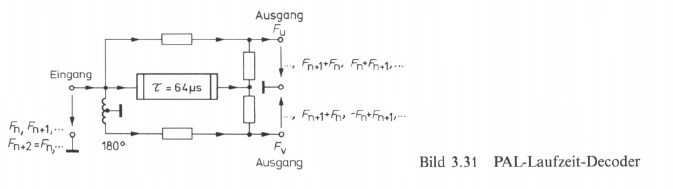

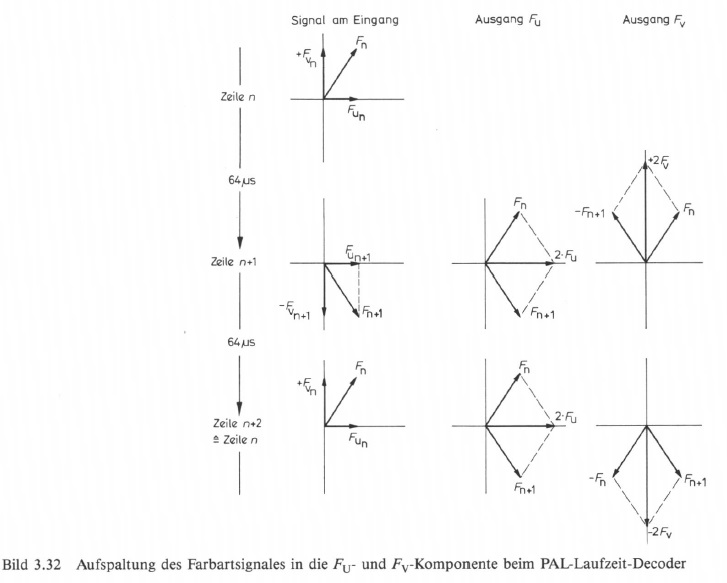

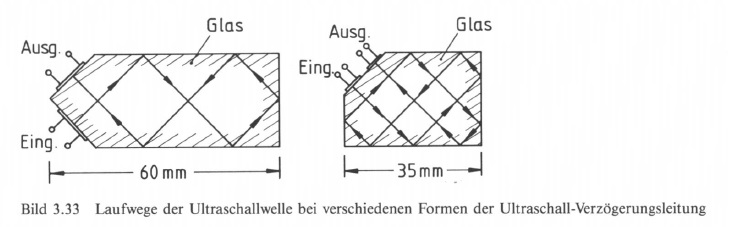

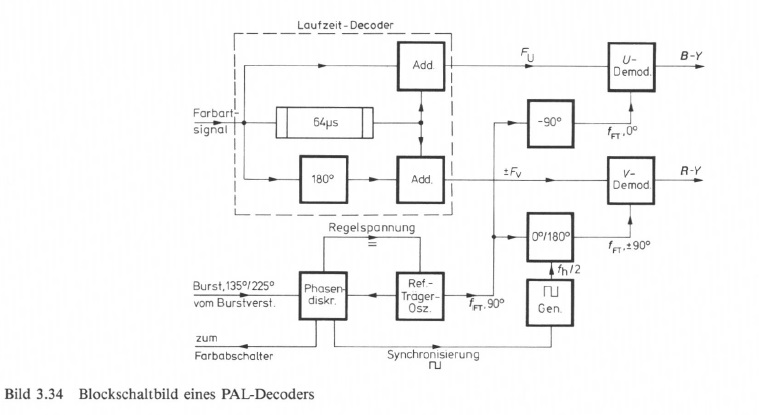

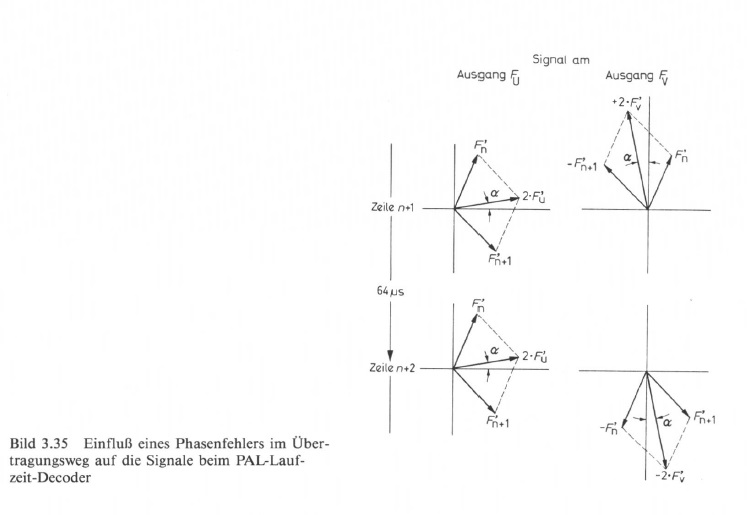

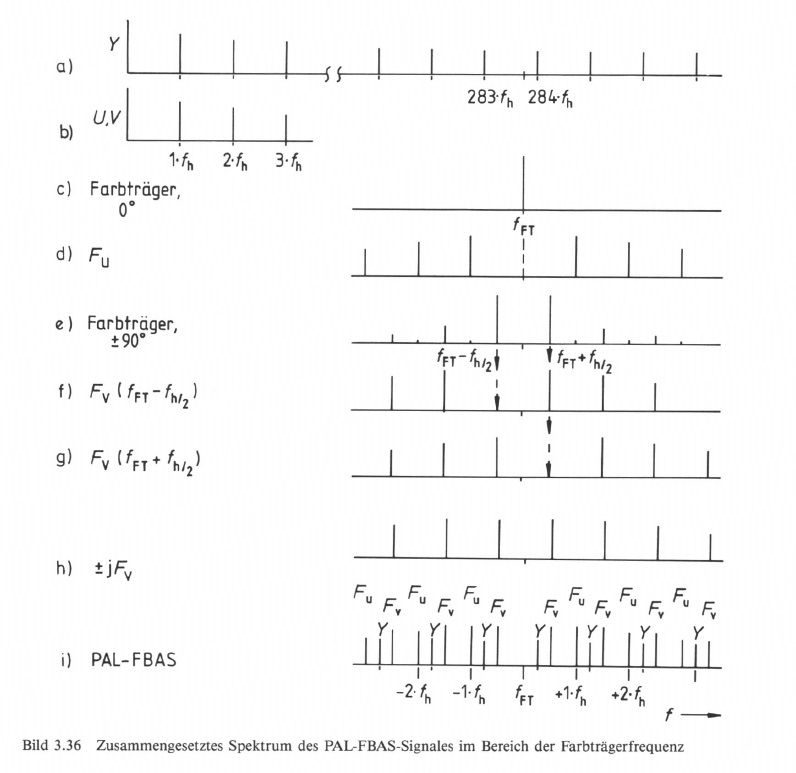

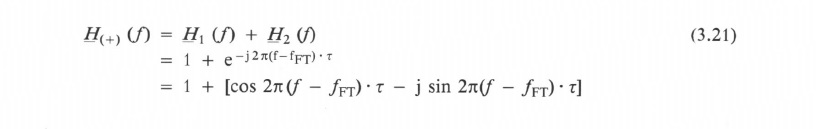

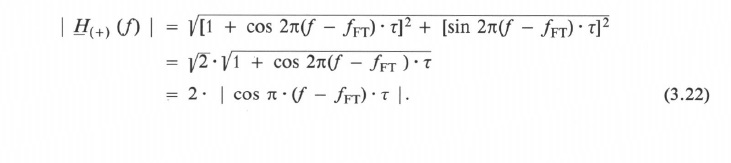

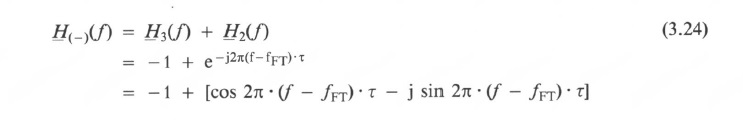

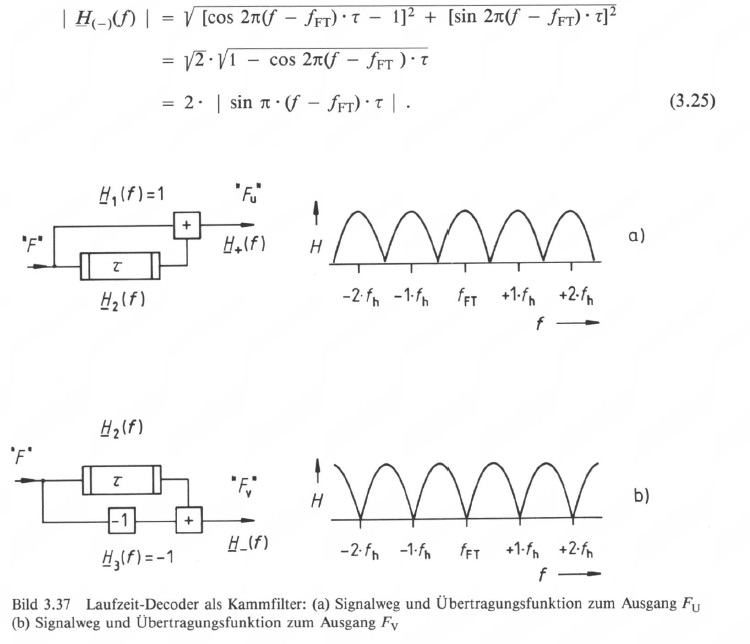

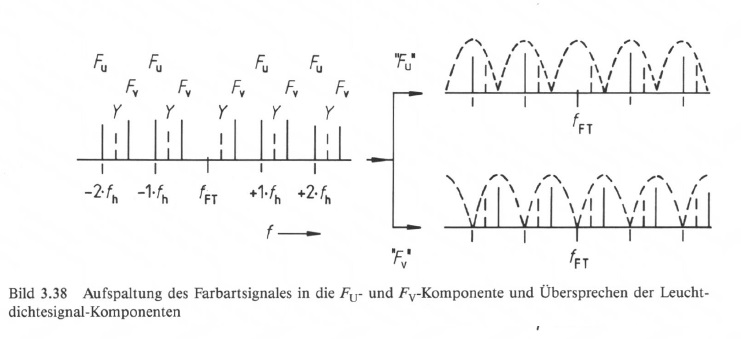

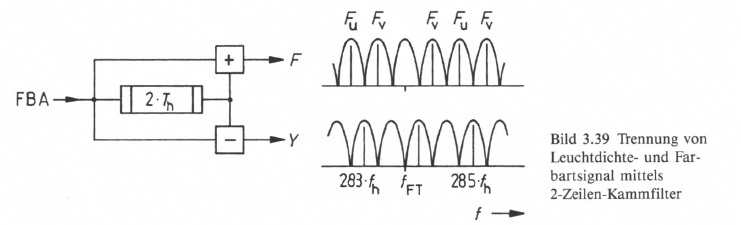

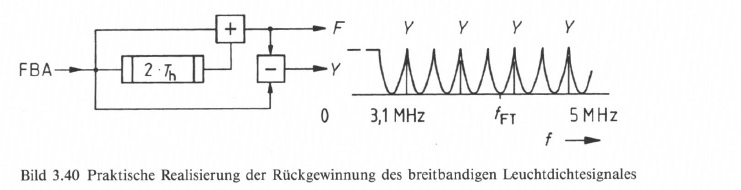

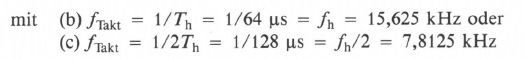

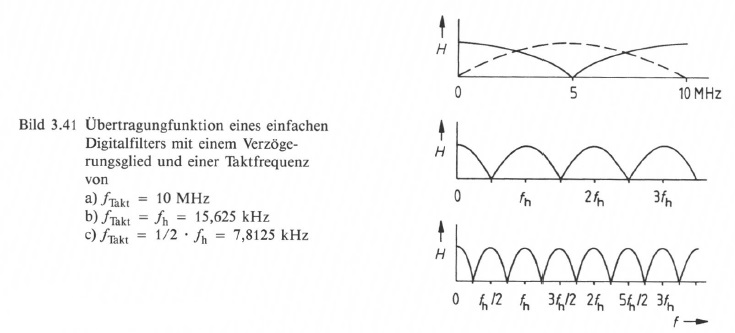

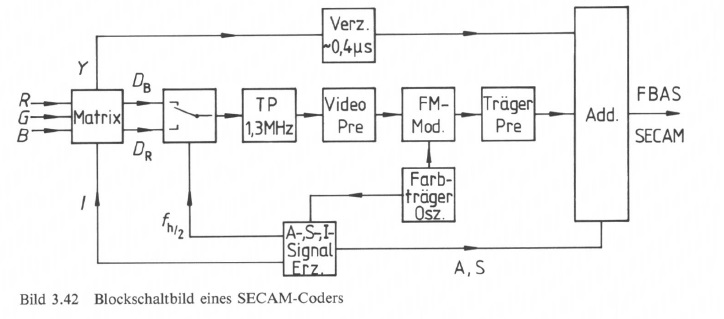

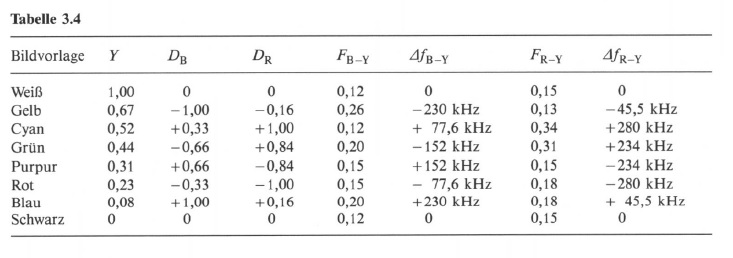

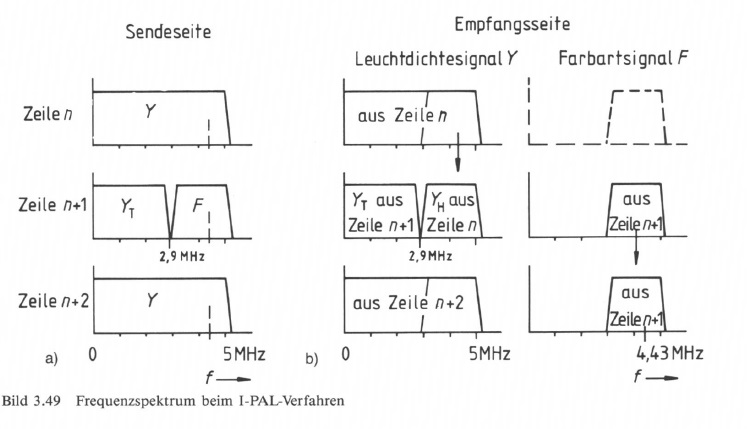

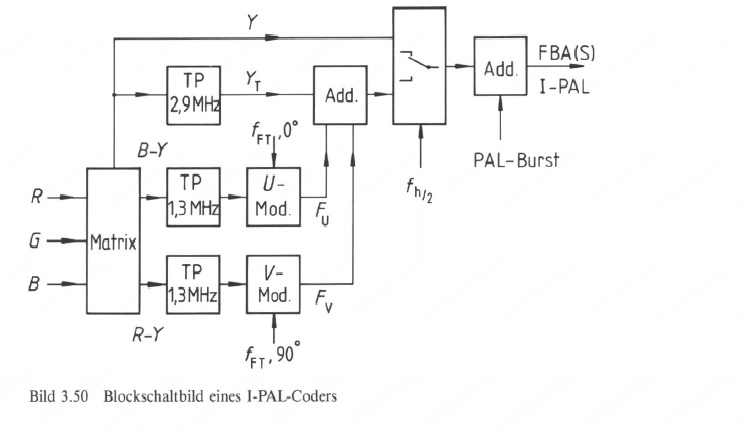

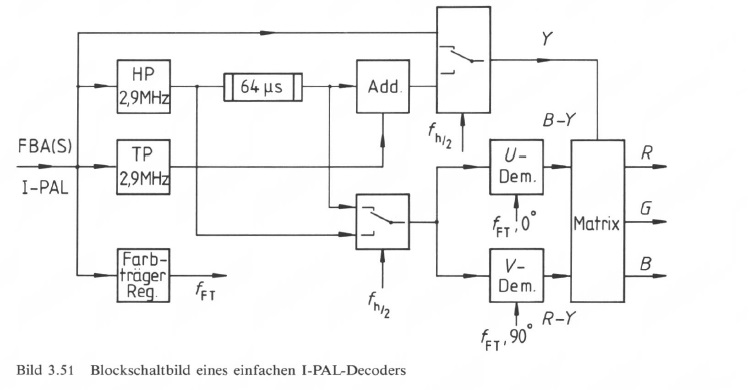

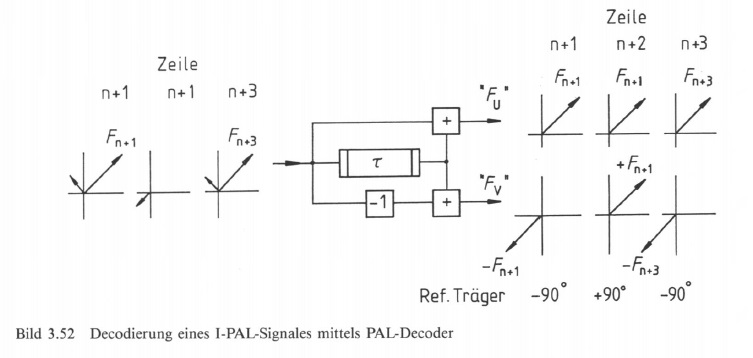

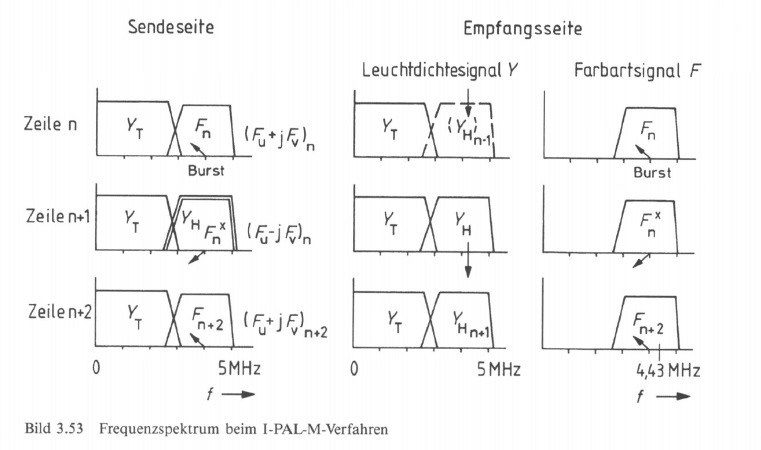

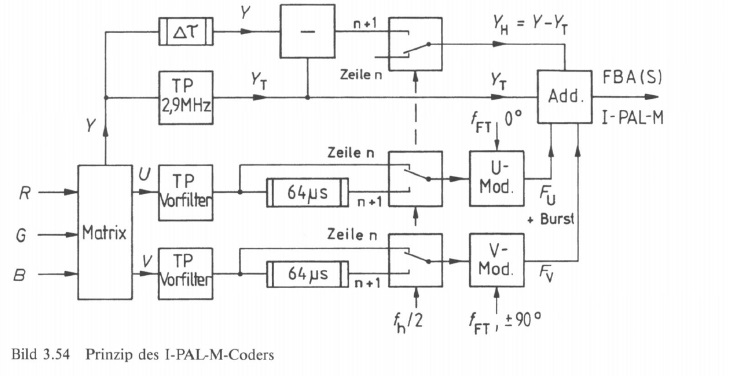

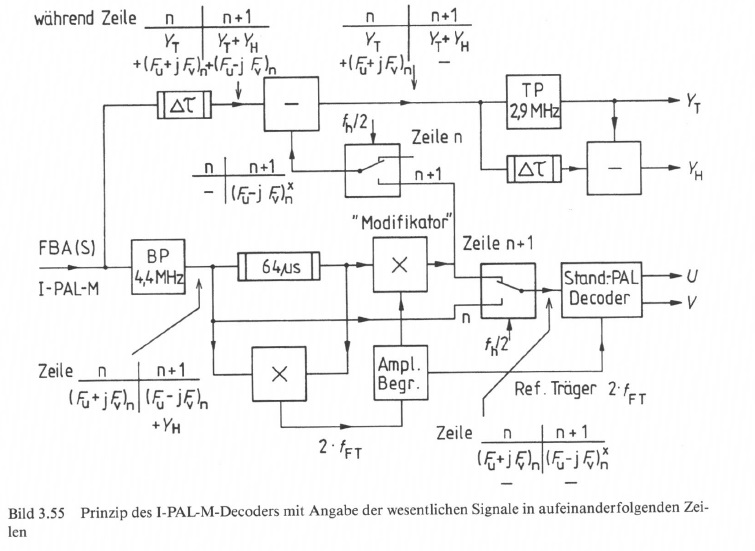

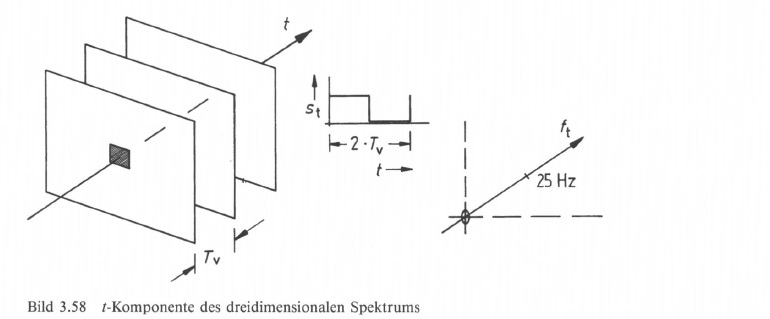

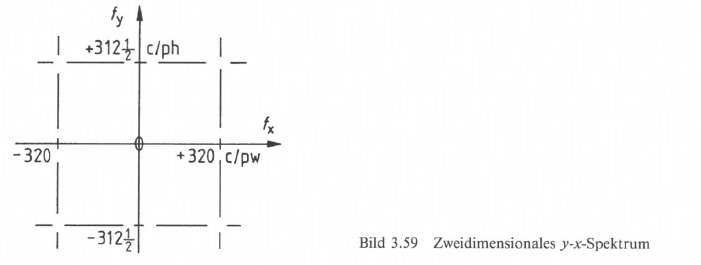

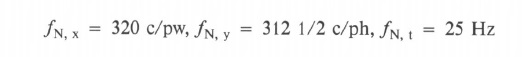

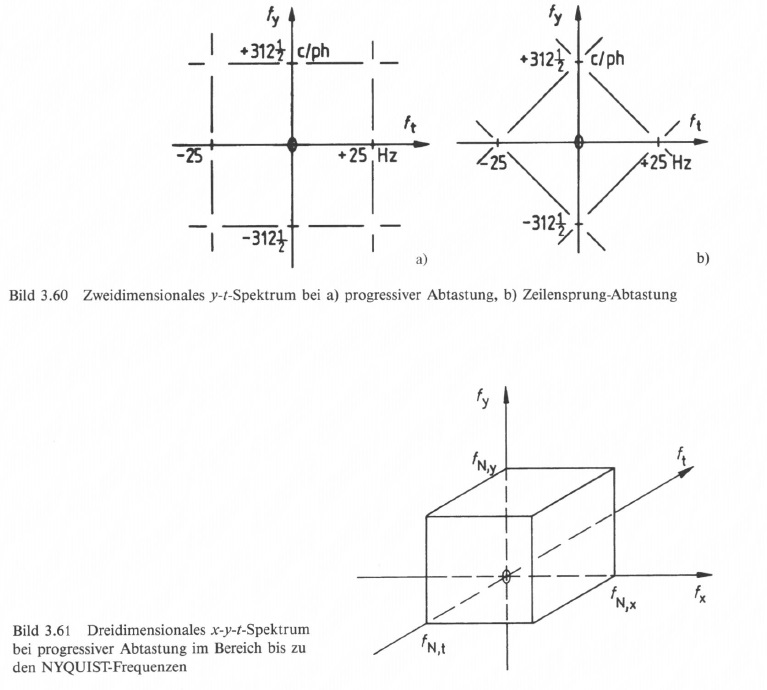

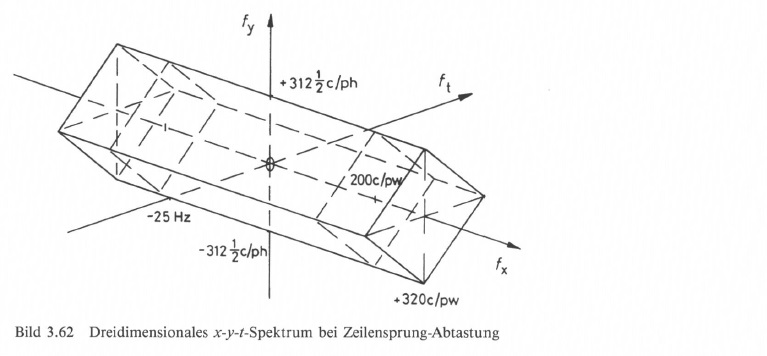

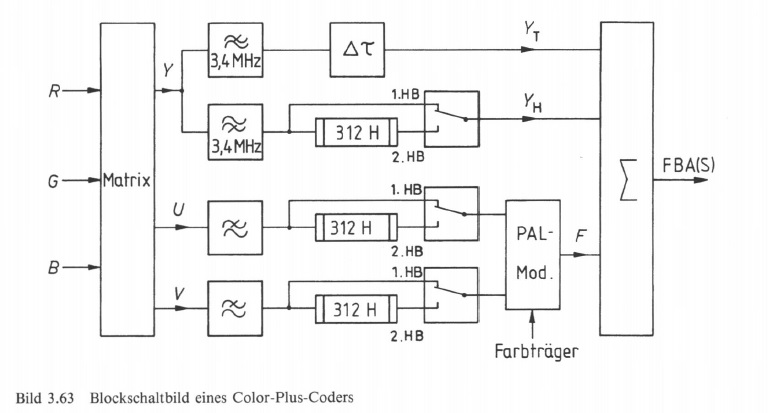

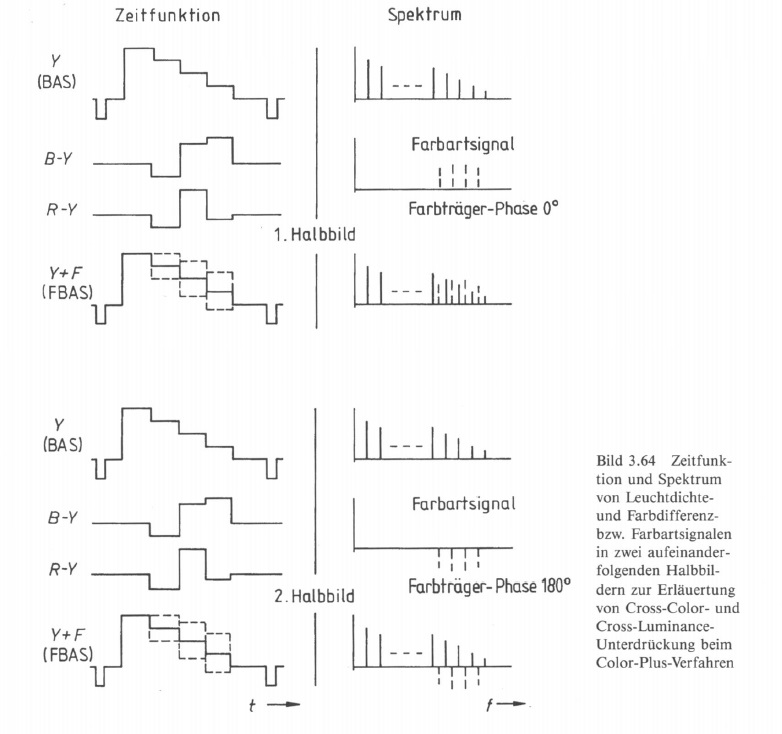

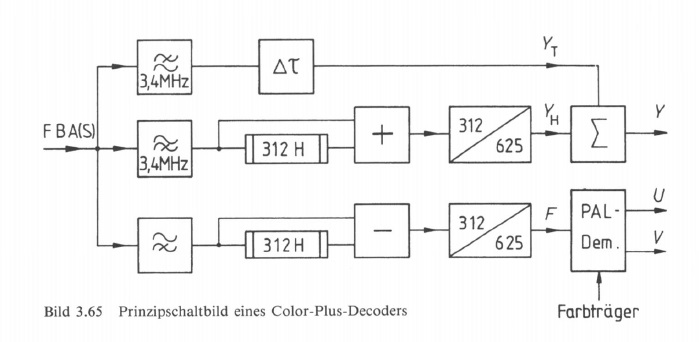

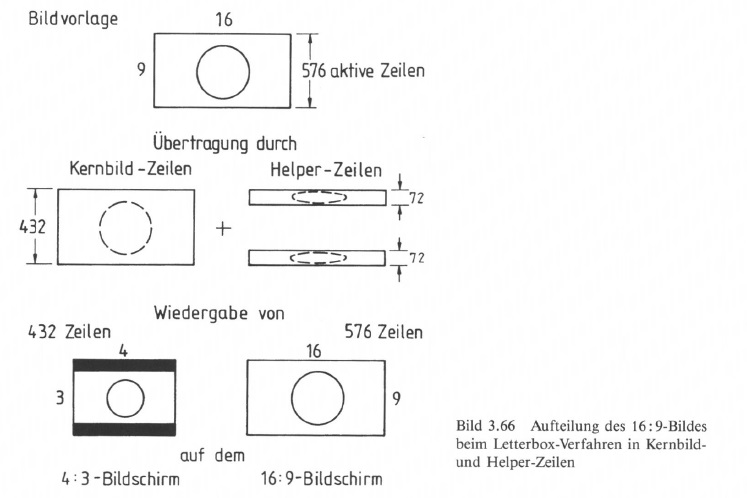

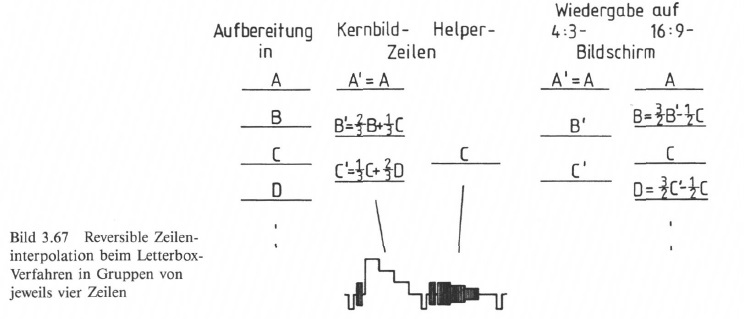

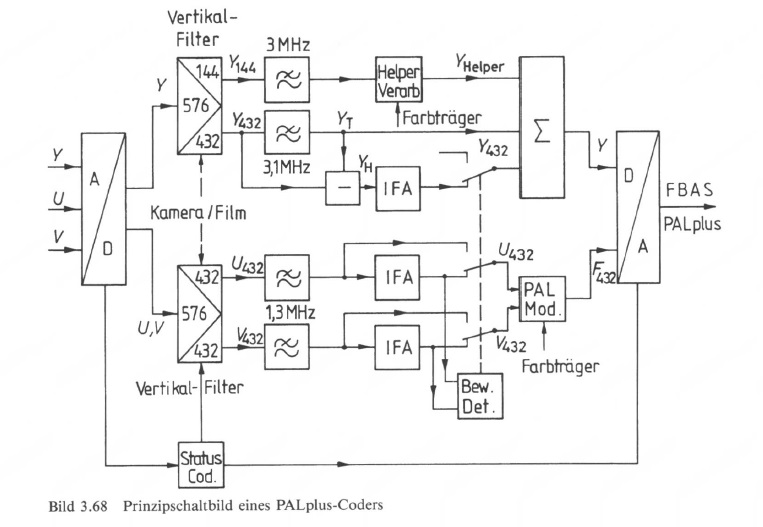

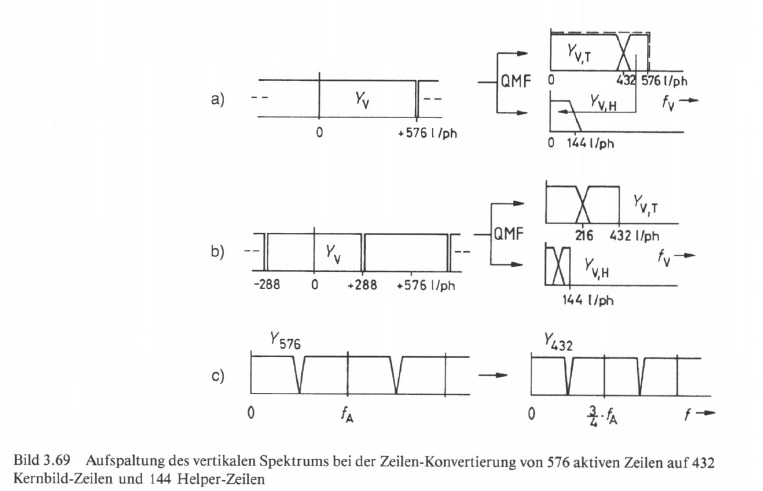

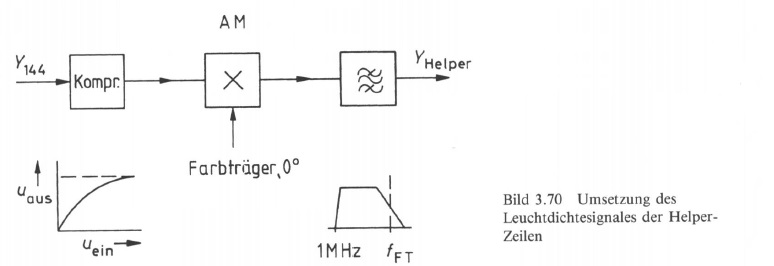

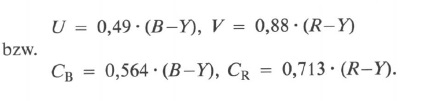

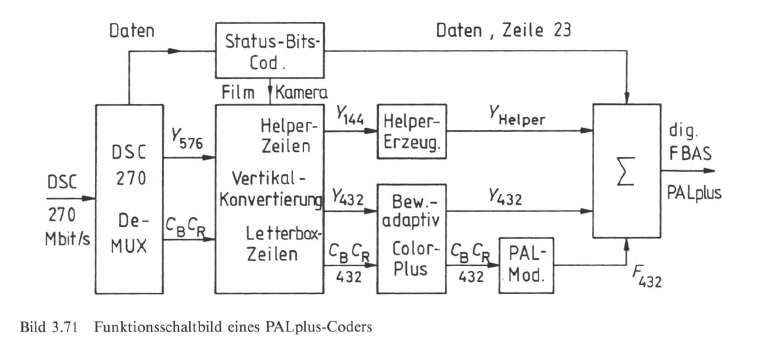

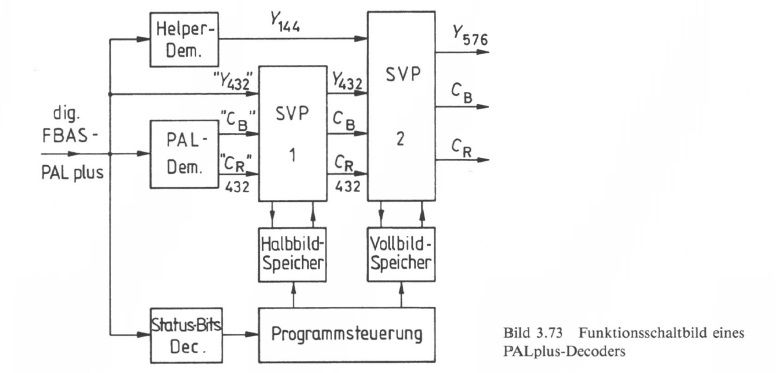

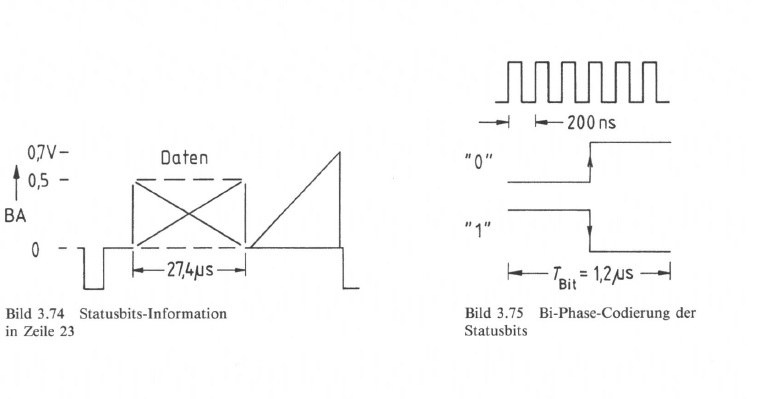

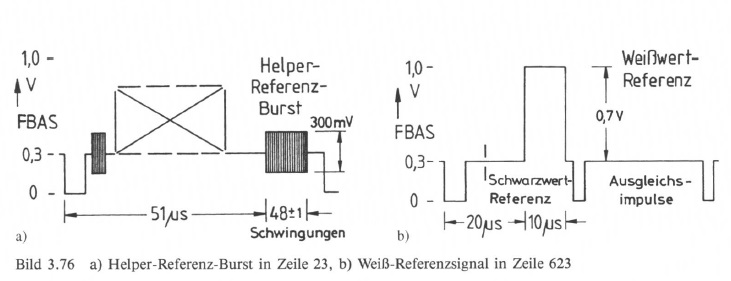

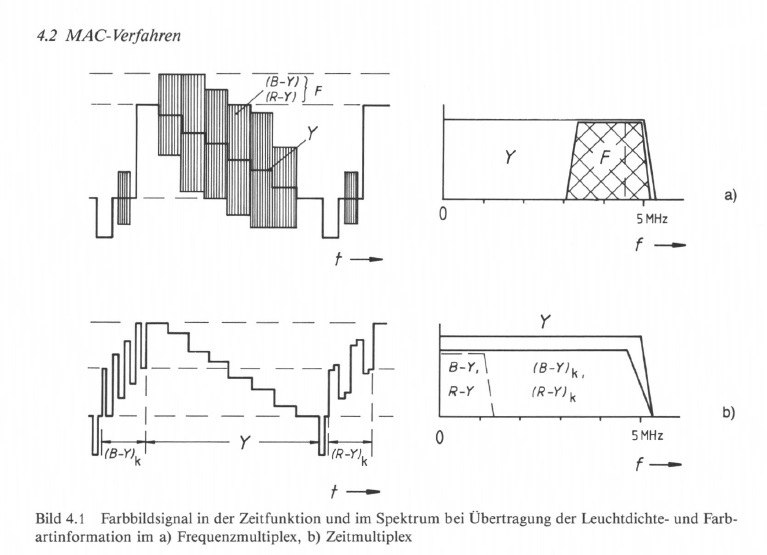

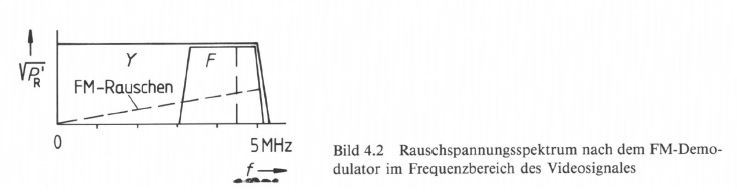

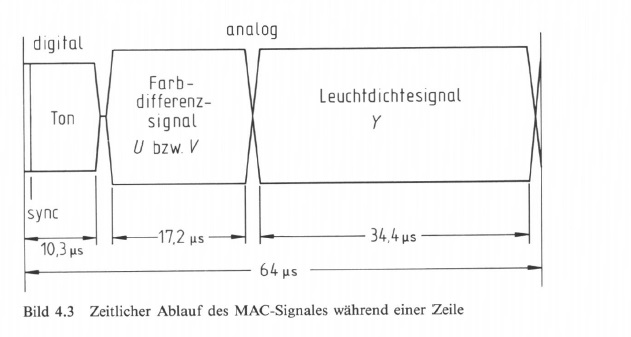

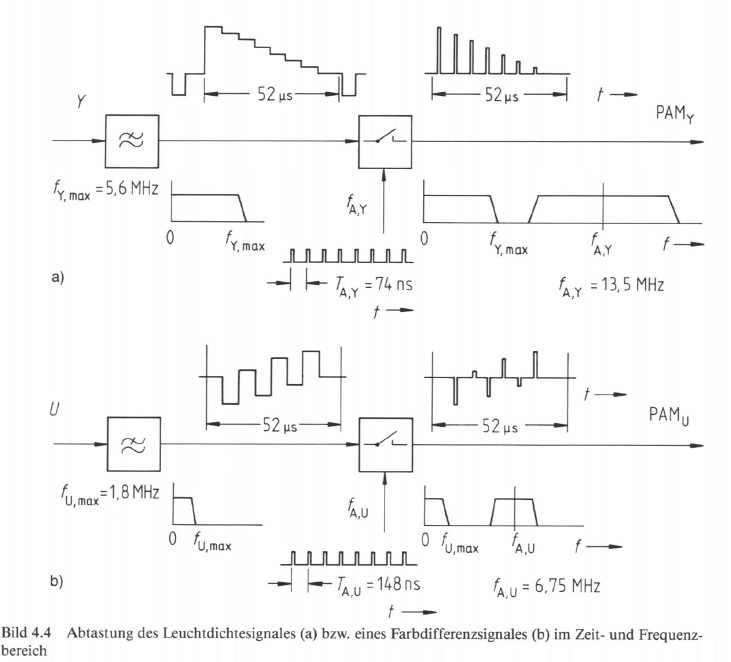

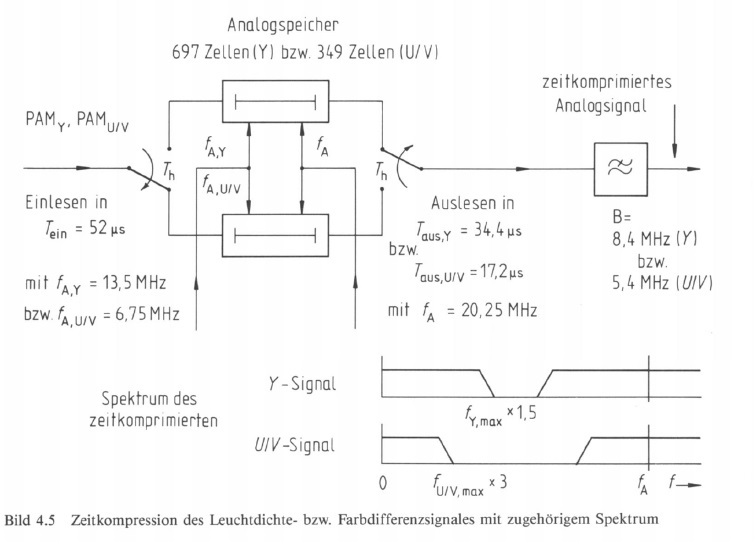

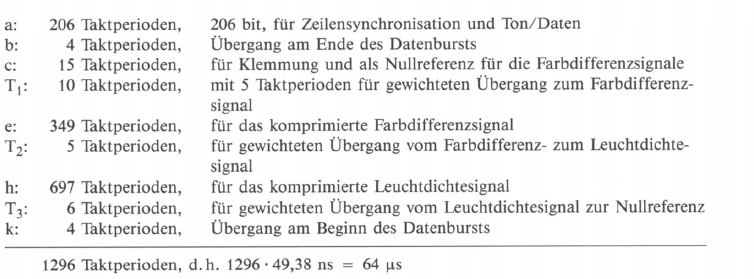

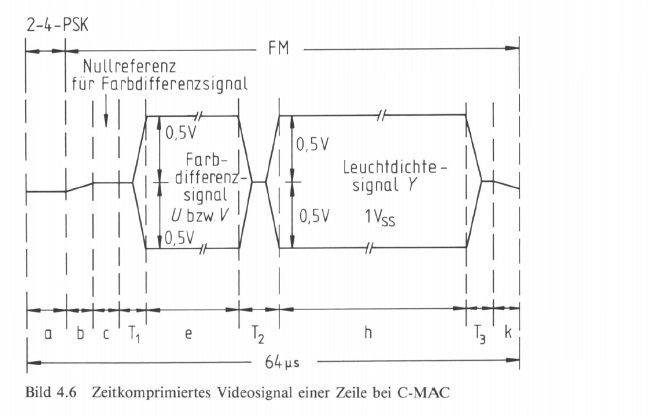

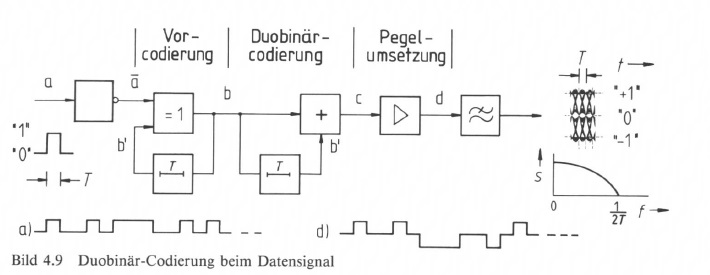

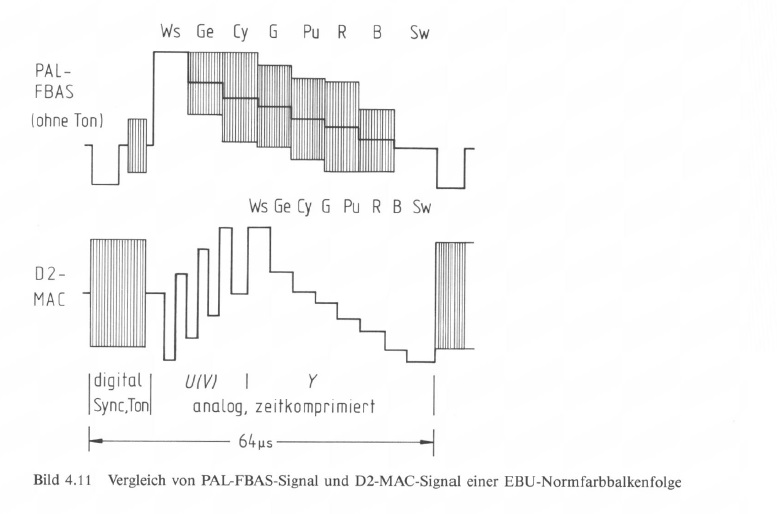

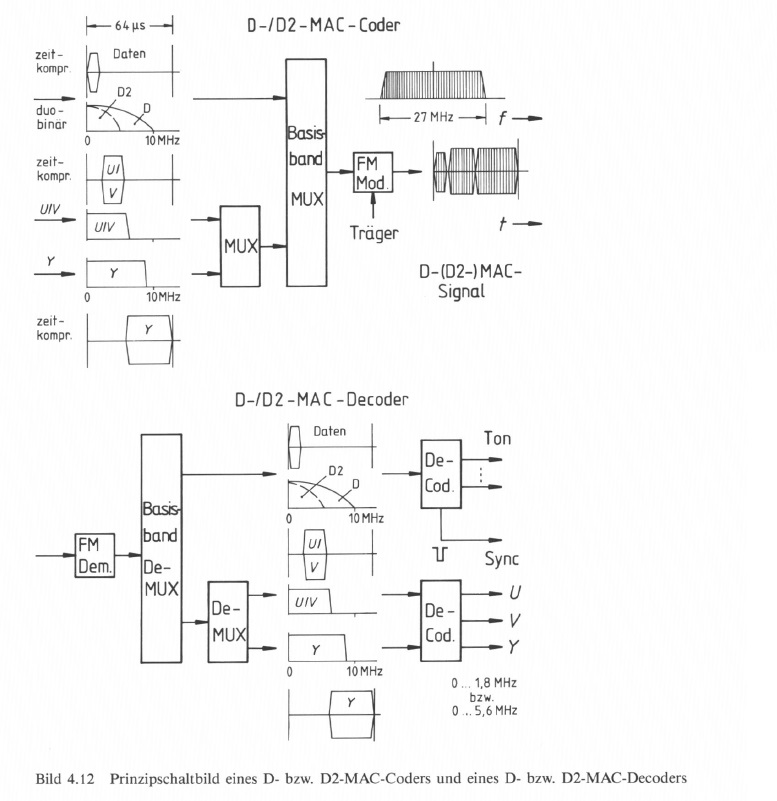

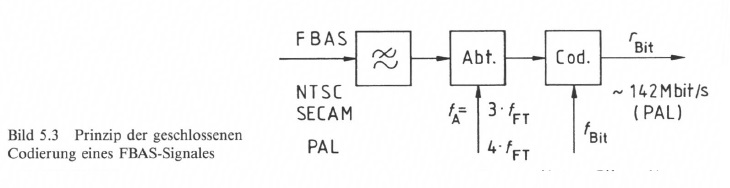

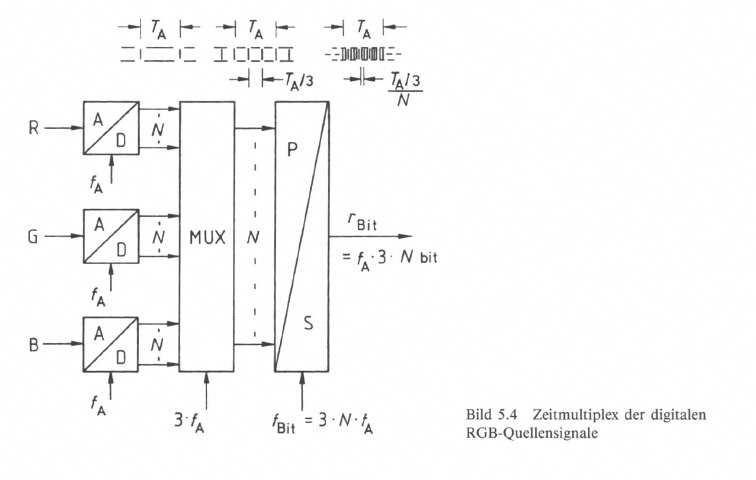

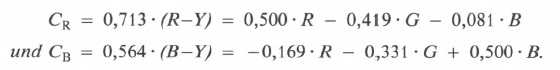

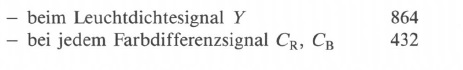

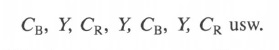

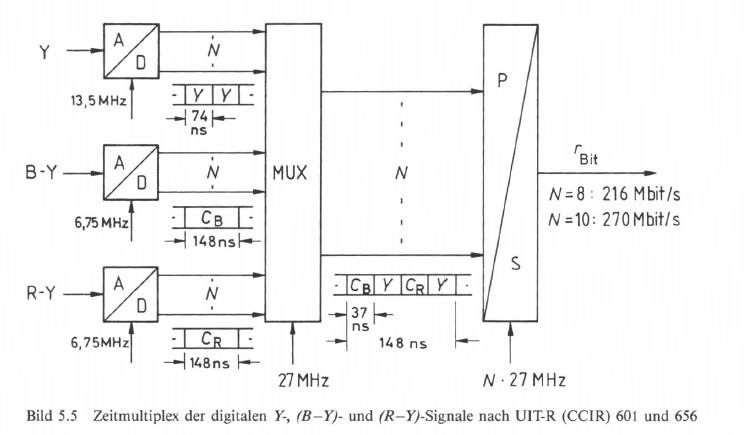

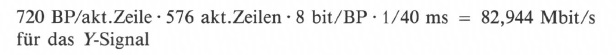

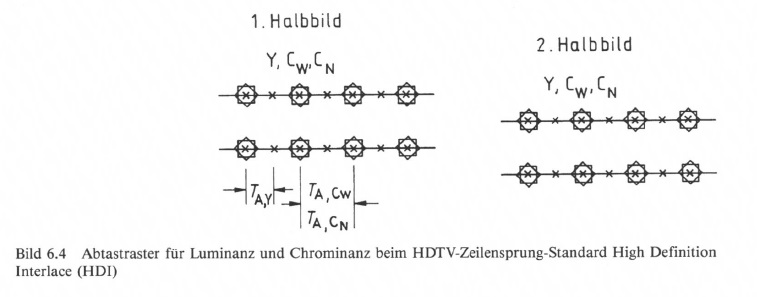

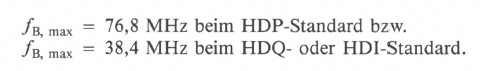

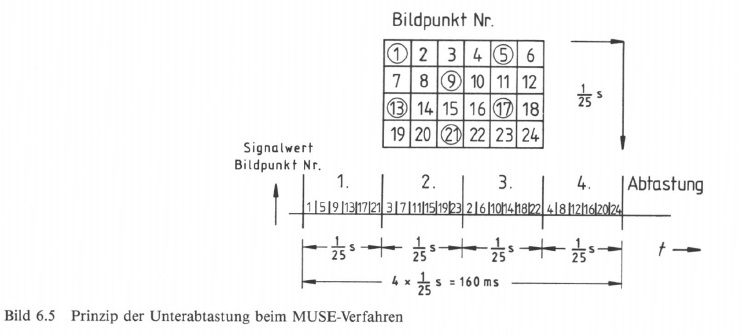

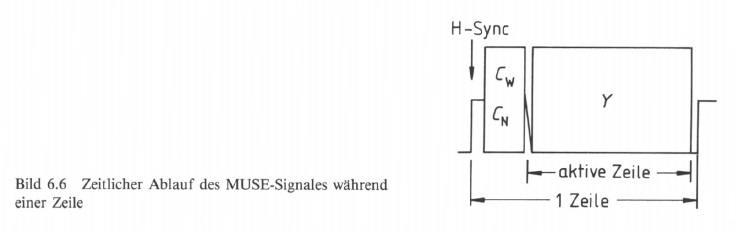

Der subjektive Störeindruck lässt sich aber dadurch reduzieren, dass die Frequenz des Farbträgers möglichst hoch gewählt wird. Das Störmuster erhält dann eine sehr feine Struktur. Eine zweite Forderung an die Frequenz des Farbträgers ist somit, dass diese möglichst am oberen Ende des Spektrums des BAS-Signales liegt.